Spis treści

- Architektura i Zasada Działania

- Jak zainstalować?

- Pobieranie modeli

- Główne sekcje panelu

- Praktyczne zastosowania

ControlNet to przełomowa architektura sieciowa zaprojektowana do precyzyjnego sterowania procesem generacji obrazów w modelach dyffuzyjnych, szczególnie w Stable Diffusion. Ta innowacyjna technologia, opracowana przez Lvmin Zhang i zespół, umożliwia użytkownikom dodawanie dodatkowych warunków kontrolnych do standardowego procesu text-to-image.

Architektura i Zasada Działania

Kluczową innowacją ControlNet jest podział sieci neuronowej na dwie części: “zablokowaną kopię” oraz “kopię trenowalna”. Zablokowana kopia zachowuje oryginalną funkcjonalność pre-trenowanego modelu Stable Diffusion, podczas gdy kopię trenowalna uczy się interpretować dodatkowe warunki kontrolne. Obie części są połączone przez “zero convolution” – konwolucję 1×1 z wagami i bias zainicjalizowanymi na zero.

Ten mechanizm gwarantuje, że przed treningiem wszystkie zero konwolucje produkują zera, co oznacza że ControlNet nie wprowadza żadnych zakłóceń do oryginalnego modelu. Dzięki temu możliwy jest trening nawet na małych zbiorach danych bez ryzyka zniszczenia produkcyjnego modelu dyffuzyjnego.

Główne Typy Modeli ControlNet

ControlNet oferuje różnorodne modele preprocesorów, z których każdy specjalizuje się w innym aspekcie kontroli obrazu:

- Canny Edge Detection – identyfikuje precyzyjne krawędzie obiektów, idealny do zachowania szczegółowej kompozycji oryginalnego obrazu

- OpenPose – rozpoznaje pozy ciała ludzkiego, umożliwiając kontrolę nad pozycjami postaci

- Depth Control – analizuje głębię obrazu, zachowując przestrzenne relacje między obiektami

- Segmentation Maps – wykorzystuje mapy segmentacji semantycznej do precyzyjnego definiowania obszarów obrazu

- Normal Maps – kontroluje powierzchnie i tekstury poprzez mapy normalnych

Jak zainstalować?

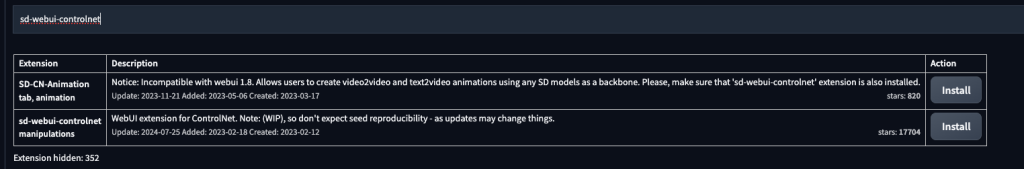

Udaj się do wtyczek (extensions) i z dostępnych wybierz sd-webui-controlnet i kliknij install.

Po instalacji przechodzimy do Installed i restartujemy i przeładowywujemy UI.

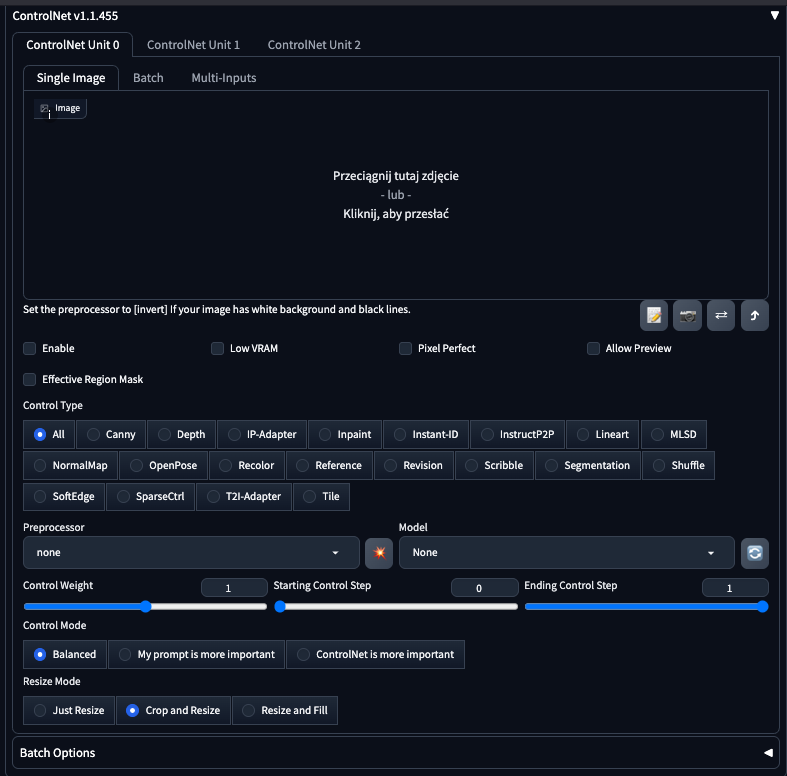

Po odświeżeniu, pojawi nam się nowy panel w txt2img.

ControlNet v1.1.455 i możemy go rozwinąć.

Pobieranie modeli

Do prawidłowego działania ControlNet potrzebuje dedykowanych modeli, które można pobrać z Hugging Face. Rekomendowane jest pobranie wszystkich dostępnych modeli dla maksymalnej elastyczności, jednak na początek wystarczą podstawowe modele jak Canny, Depth i OpenPose. Przenosimy je do folderu models/ControlNet

Główne sekcje panelu

Sekcja obrazu: W górnej części panelu znajduje się obszar do przesyłania obrazów referencyjnych. Można tutaj przeciągnąć obraz lub kliknąć, aby go wybrać z plików.

Opcje podstawowe:

- Enable: Aktywuje funkcjonalność ControlNet.

- Low VRAM: Optymalizuje użycie pamięci dla słabszych kart graficznych.

- Pixel Perfect: Automatycznie dostosowuje rozdzielczość ControlNet do wymiarów obrazu.

- Allow Preview: Umożliwia podgląd przetworzonego obrazu przez preprocessor.

Typy kontroli (Control Types)

ControlNet oferuje szeroką gamę preprocessorów, każdy przeznaczony do różnych zastosowań:

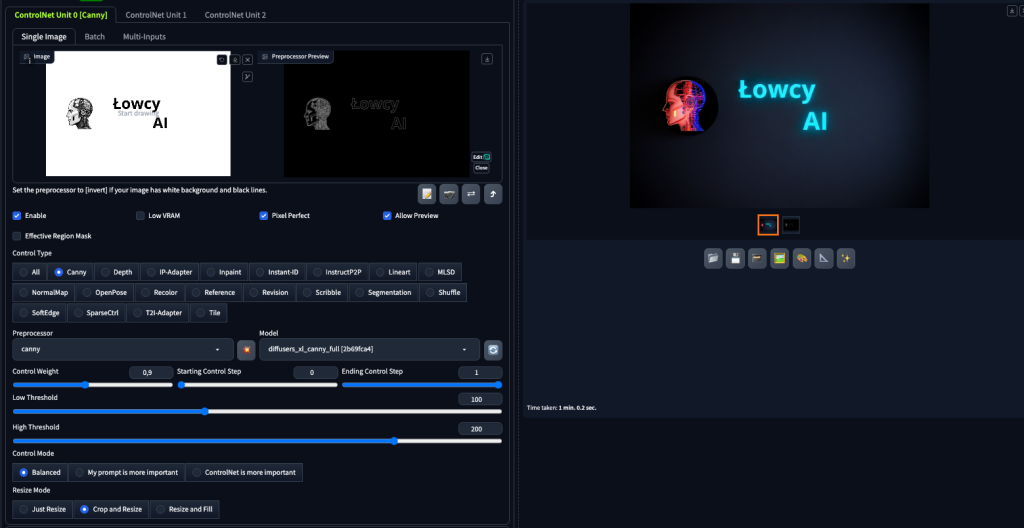

Canny Edge Detection

Canny to preprocessor wykrywający krawędzie w obrazie. Świetnie nadaje się do zachowania struktury obiektów przy jednoczesnej zmianie ich stylu. Canny analizuje kontury i linie, tworząc mapę krawędzi, która następnie kieruje procesem generowania.

Depth (Głębia)

Preprocessor Depth szacuje podstawową mapę głębi z obrazu referencyjnego. Mapa głębi to dwuwymiarowa reprezentacja w skali szarości sceny 3D, gdzie wartość każdego piksela odpowiada odległości obiektów od obserwatora. Umożliwia to odtwarzanie kompozycji, póz i kształtów.

OpenPose

OpenPose wykrywa pozycje człowieka, identyfikując kluczowe punkty ciała takie jak:

- OpenPose: Podstawowe punkty – oczy, nos, szyja, ramiona, łokcie, nadgarstki, kolana, kostki

- OpenPose_face: OpenPose plus szczegóły twarzy

- OpenPose_hand: OpenPose plus dłonie i palce

- OpenPose_faceonly: Tylko szczegóły twarzy

- OpenPose_full: Wszystkie powyższe elementy

Inne preprocessory

- MLSD (Mobile Line Segment Detection): Wykrywa linie i segmenty w obrazie

- Scribble: Umożliwia tworzenie obrazów na podstawie szkiców

- Segmentation: Dzieli obraz na różne segmenty

- Tile: Pomaga w regenerowaniu utraconych szczegółów

- Reference: Służy do tworzenia wariacji stylistycznych

Kluczowe ustawienia ControlNet

Control Weight (Waga kontroli)

Control Weight określa, jak bardzo ControlNet wpływa na generowany obraz. Wartości wahają się od 0 do 2, gdzie:

- 0.0-0.5: Słaby wpływ ControlNet

- 0.6-1.0: Standardowy wpływ (zalecane)

- 1.0-1.5: Silny wpływ

- 1.5-2.0: Bardzo silny wpływ (może prowadzić do “overfitting”)11

Control Mode (Tryb kontroli)

Dostępne są trzry tryby kontroli:

- Balanced: Zrównoważony wpływ prompta i ControlNet

- My prompt is more important: Priorytet dla prompta tekstowego

- ControlNet is more important: Priorytet dla kontroli ControlNet

Starting/Ending Control Step

Te parametry określają, w którym momencie procesu generowania ControlNet zaczyna i kończy swoje działanie. Standardowo:

- Starting Control Step: 0 (początek)

- Ending Control Step: 1 (koniec)

Resize Mode (Tryby zmiany rozmiaru)

ControlNet oferuje trzy tryby dopasowywania obrazów:

- Just Resize – Podstawowe przeskalowanie obrazu do docelowych wymiarów.

- Crop and Resize – Przycina obraz zachowując proporcje, a następnie skaluje. Użytkownik może wybrać obszar do przycięcia.

- Resize and fill – Dopasowuje obraz do docelowego obszaru dodając tło, aby uniknąć zniekształceń. Zachowuje oryginalne proporcje.

Jak to wygląda w praktyce?

Po wejściu w zakładkę przesyłamy obraz który ma służyć za wzór do generowania przyszłych obrazów lub mają być wkomponowane w obraz i wybieramy odpowiadające nam modele i ustawienia.

Każde generowanie grafik wymaga indywidualnej uwagi i prób ze względu na wiele możliwości wyborów modeli stable diffusion oraz też różnych rozdzielczości generowania obrazów. Nie ma uniwersalnych ustawień które dadzą wszędzie dobre efekty.

Dla przykładu spróbujemy przerobić logo bloga.

Warto testować różne warianty by uzyskać jak najlepsze rezultaty choć może to być czasochłonne.

Praktyczne Zastosowania

ControlNet znajduje szerokie zastosowanie w różnych dziedzinach:

Generowanie Syntetycznych Danych – Badania pokazują, że ControlNet znacząco poprawia jakość syntetycznych obrazów wykorzystywanych do treningu modeli AI. W przypadku wykrywania chwastów, połączenie rzeczywistych i syntetycznych obrazów wygenerowanych przez ControlNet przyniosło poprawę dokładności.

Architektura i Projektowanie – W wizualizacji architektonicznej ControlNet z warstwą Depth pozwala na przekształcanie prostych modeli 3D (np. z SketchUp) w fotorealistyczne wizualizacje, zachowując przy tym precyzyjną kontrolę nad kompozycją i głębią sceny.

Sztuka i Design – Artyści wykorzystują ControlNet do transferu stylu i tworzenia obrazów artystycznych. Badania nad malarstwem Jiehua wykazały, że Fine-tuned Stable Diffusion Model z ControlNet (FSDMC) osiągnął wynik FID równy 3,27, przewyższając tradycyjne modele jak CycleGAN.

Segmentacja Semantyczna – ControlNet wspiera tworzenie syntetycznych obrazów dla poprawy modeli segmentacji semantycznej, wykorzystując jednocześnie mapy głębi, detekcję krawędzi Canny oraz mapy segmentacji.

Optymalizacje i Rozwiązania Techniczne

Najnowsze badania skupiają się na rozwiązywaniu ograniczeń ControlNet. Framework CtrLoRA zmniejsza liczbę parametrów do uczenia o 90% w porównaniu do standardowego ControlNet, wymagając jedynie 1000 par danych i mniej niż godziny treningu na pojedynczym GPU dla większości scenariuszy.

DC-ControlNet wprowadza hierarchiczną kontrolę, rozdzielając warunki na elementy intra-elementowe i inter-elementowe, co umożliwia bardziej precyzyjną kontrolę nad generacją wieloelementowych kompozycji.

Źródła

- ControlNet – Control Diffusion Models – Stable Diffusion Online

- Guide to ControlNet | getimg.ai

- Stable Diffusion ControlNet Tutorial – Full Guide – CreatixAI

- ControlNet: A Complete Guide – Stable Diffusion Art

- lllyasviel/ControlNet: Let us control diffusion models! – GitHub

- Weed image augmentation by ControlNet-added stable diffusion

- Enhancing Semantic Segmentation with Synthetic Image Generation: A Novel Approach Using Stable Diffusion and ControlNet

- JieHua Paintings Style Feature Extracting Model using Stable Diffusion with ControlNet

- Jak tworzyć fotorealistyczne wizualizacje w AI? – CGwisdom.pl