- Dlaczego harmonogram jest stopniowy

- Przegląd czterech kluczowych dat

- 2 lutego 2025 – zakazy i AI literacy

- 2 sierpnia 2025 – GPAI i struktury nadzorcze

- 2 sierpnia 2026 – główna fala obowiązków

- 2 sierpnia 2027 – systemy zintegrowane z produktami sektorowymi

- Tabela: data → co obowiązuje → kogo dotyczy

- Praktyczne zastosowania dla firm

- Źródła

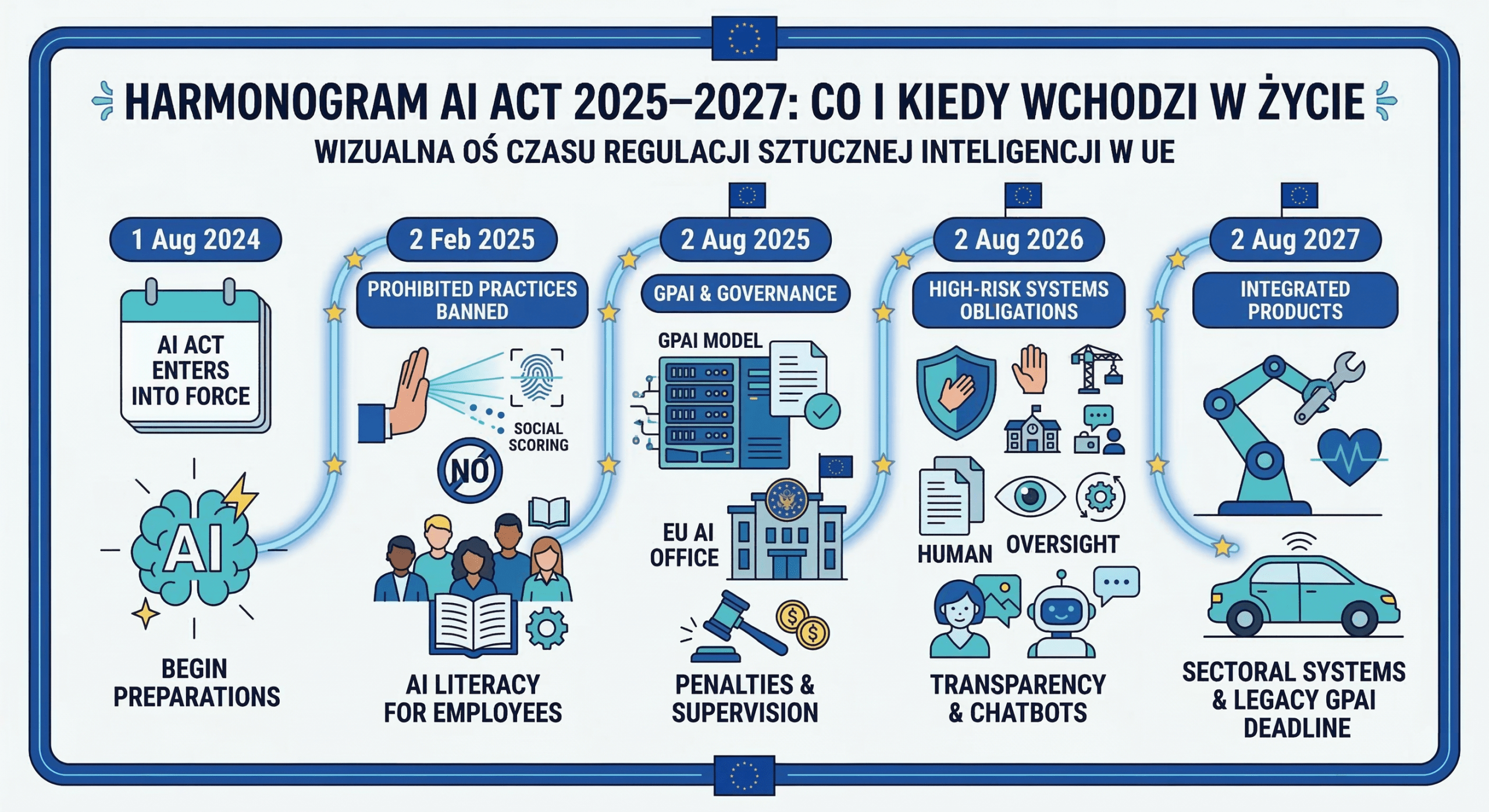

Unijne rozporządzenie o sztucznej inteligencji (AI Act) weszło w życie 1 sierpnia 2024 roku, ale jego przepisy nie zaczęły obowiązywać jednocześnie. Ustawodawca zaplanował cztery główne etapy wdrożenia rozłożone na lata 2025–2027, kierując kolejne obowiązki do różnych grup podmiotów. Poniżej szczegółowy breakdown każdej daty i ich praktyczne konsekwencje dla firm, dostawców AI i instytucji publicznych.

Dlaczego harmonogram jest stopniowy

Komisja Europejska celowo zaprojektowała wdrożenie kaskadowo, zaczynając od tematów o najwyższym ryzyku społecznym, a kończąc na bardziej złożonych, sektorowych wymaganiach technicznych. Oznacza to, że każda faza daje organizacjom od 6 do 12 miesięcy na przygotowanie przed kolejnym etapem. Ignorowanie harmonogramu wiąże się z realnymi karami finansowymi – możliwość ich nakładania pojawiła się wraz z fazą sierpniową 2025 roku.

Przegląd czterech kluczowych dat

2 lutego 2025 – zakazy i AI literacy

To była pierwsza operacyjna data w całym harmonogramie. Od tego dnia obowiązuje zakaz stosowania systemów AI, które naruszają podstawowe prawa – takich jak systemy do biometrycznej kategoryzacji według cech wrażliwych, subliminalnego manipulowania zachowaniem czy systemów oceny społecznej (social scoring). Równolegle wszedł w życie wymóg AI literacy – organizacje muszą zapewnić pracownikom, którzy mają kontakt z systemami AI, podstawową świadomość na temat działania tych narzędzi i związanych z nimi ryzyk. To dotyczy praktycznie każdej firmy, która korzysta z gotowych narzędzi AI, nie tylko tych, które AI tworzą.

2 sierpnia 2025 – GPAI i struktury nadzorcze

Drugi etap skierowany był przede wszystkim do dostawców modeli AI ogólnego przeznaczenia (ang. General Purpose AI, GPAI), czyli takich jak duże modele językowe. Dostawcy GPAI wprowadzający nowe modele po tej dacie muszą spełniać pełen zestaw obowiązków: dokumentację techniczną, politykę praw autorskich i – w przypadku modeli o dużym potencjale ryzyka systemowego – dodatkowe oceny bezpieczeństwa. Jednocześnie uruchomiono ramy zarządzania: AI Office na poziomie UE oraz krajowe organy nadzoru w państwach członkowskich zostały formalnie operacyjne. Co istotne: od 2 sierpnia 2025 możliwe jest już nakładanie kar za naruszenia przepisów obowiązujących na tym etapie.

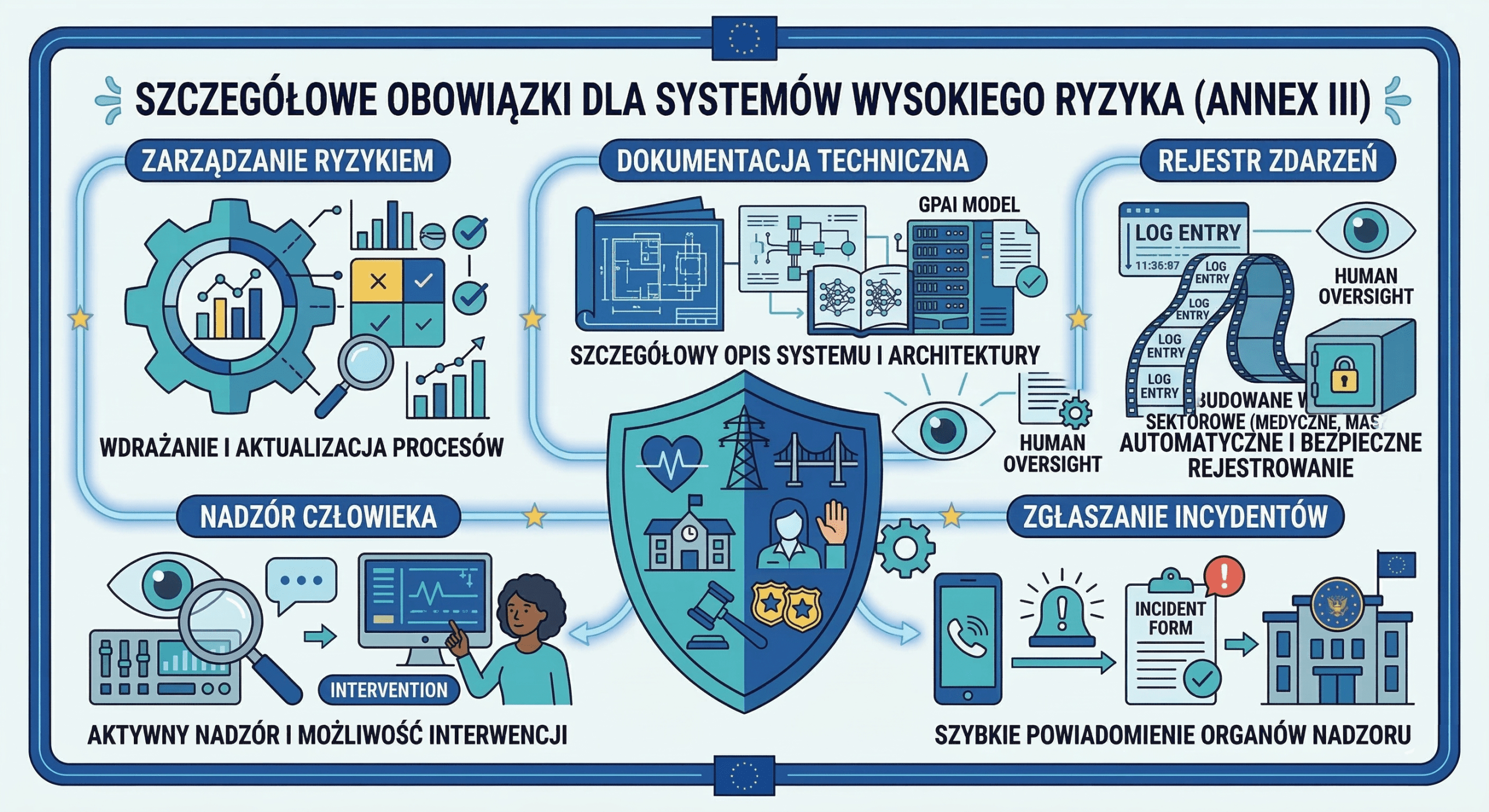

2 sierpnia 2026 – główna fala obowiązków

To najważniejsza data dla zdecydowanej większości firm. Od tego dnia wchodzą w życie pełne wymogi dla systemów AI wysokiego ryzyka wymienionych w Załączniku III, czyli m.in. systemów stosowanych w biometrii, infrastrukturze krytycznej, edukacji, rekrutacji, wymiarze sprawiedliwości i ściganiu przestępstw. Dostawcy i wdrażający takie systemy muszą wdrożyć zarządzanie ryzykiem, dokumentację techniczną, nadzór człowieka, rejestr zdarzeń i zgłaszać incydenty do nadzorcy. Obowiązują też przepisy o przejrzystości wobec użytkowników dla systemów generujących treści syntetyczne (art. 50), w tym chatbotów i systemów rozpoznawania emocji. Równocześnie Komisja uzyskuje uprawnienia wykonawcze do wydawania decyzji i nakładania sankcji na poziomie centralnym.

2 sierpnia 2027 – systemy zintegrowane z produktami sektorowymi

Ostatni etap obejmuje wąską, ale technicznie skomplikowaną grupę: systemy AI wysokiego ryzyka z Załącznika I, które są wbudowane w produkty już objęte unijnymi regulacjami sektorowymi – np. wyroby medyczne (MDR/IVDR), maszyny, pojazdy autonomiczne czy sprzęt lotniczy. Dodatkowy czas wynika z konieczności synchronizacji z procedurami certyfikacyjnymi i jednostkami notyfikowanymi właściwymi dla każdego sektora. Co więcej, operatorzy systemów GPAI, które były już na rynku przed sierpniem 2025, mają do tej daty czas na dostosowanie się.

Tabela: data → co obowiązuje → kogo dotyczy

| Data | Co wchodzi w życie | Kogo dotyczy |

|---|---|---|

| 1 sierpnia 2024 | AI Act wchodzi w życie (bez bezpośrednich obowiązków operacyjnych) | Wszyscy – etap świadomości i przygotowań |

| 2 lutego 2025 | Zakaz praktyk zakazanych (social scoring, manipulacja, biometria kategoryzacyjna); wymóg AI literacy | Wszyscy dostawcy i wdrażający AI operujący w UE |

| 2 sierpnia 2025 | Obowiązki GPAI (dokumentacja, prawa autorskie, ocena ryzyka systemowego); uruchomienie AI Office i krajowych organów nadzoru; możliwość nakładania kar | Dostawcy modeli GPAI (LLM i inne modele fundamentalne); państwa członkowskie |

| 2 sierpnia 2026 | Pełne wymogi dla systemów wysokiego ryzyka (Annex III): zarządzanie ryzykiem, nadzór człowieka, dokumentacja, monitoring; obowiązki transparentności (art. 50); pełne uprawnienia wykonawcze Komisji | Dostawcy i operatorzy systemów AI w obszarach: biometria, infrastruktura krytyczna, edukacja, rekrutacja, ocena kredytowa, wymiar sprawiedliwości, ściganie przestępstw |

| 2 sierpnia 2027 | Wymogi dla AI wbudowanego w produkty regulowane sektorowo (Annex I); koniec okresu przejściowego dla legacy GPAI | Producenci wyrobów medycznych, maszyn, urządzeń lotniczych i innych produktów objętych dyrektywami UE; operatorzy GPAI z rynku sprzed 2025 r. |

Praktyczne zastosowania dla firm

Dla większości przedsiębiorstw kluczowym działaniem teraz (marzec 2026) jest finalizacja klasyfikacji ryzyka wszystkich używanych i wdrażanych systemów AI przed sierpniem 2026. To jest etap, który Komisja Europejska określa jako 12–18-miesięczny projekt dla typowej organizacji – co oznacza, że firmy, które zaczęły go dopiero teraz, mają bardzo napięty harmonogram.

Warto uwzględnić cztery konkretne kroki operacyjne:

- Przeprowadzenie inwentaryzacji wszystkich systemów AI w organizacji i przypisanie im kategorii ryzyka według kryteriów AI Act

- Wdrożenie wymogów AI literacy – szkoleń i procedur – jeżeli nie zostało to wykonane po lutym 2025

- Przygotowanie dokumentacji technicznej i systemu zarządzania ryzykiem dla systemów klasyfikowanych jako wysokiego ryzyka (Annex III) przed 2 sierpnia 2026

- Weryfikacja, czy którykolwiek z systemów kwalifikuje się do Annex I (produkty sektorowe) – jeśli tak, konieczna jest koordynacja z jednostkami notyfikowanymi i dłuższa ścieżka certyfikacyjna do 2027

Firmy, które nie są dostawcami AI, ale tylko je wdrażają (ang. deployers), nie są zwolnione z obowiązków – AI Act nakłada na nie odrębne wymogi dotyczące nadzoru i przejrzystości wobec użytkowników końcowych. Warto mieć to na uwadze przy audycie używanych narzędzi SaaS i platform AI.

Źródła

- Komisja Europejska – AI Act, harmonogram stosowania

- EU AI Act Service Desk – harmonogram wdrażania

- Staniek & Partners – AI Act 2026: daty i obowiązki

- Glocert International – EU AI Act Timeline & Key Dates

- TechLaw.ie – EU AI Act Timeline Update (marzec 2026)

- artificialintelligenceact.eu – Implementation Next Steps

- PCSID – Road mapa wdrożenia AI Act w firmie