Kontekst techniczny i znaczenie dla branży

FLUX.2 reprezentuje znaczący skok w ewolucji modeli generowania obrazów, wprowadzając architekturę opartą na rectified flow matching połączoną z modelem vision-language. Różni się od poprzednich podejść tym, że jednocześnie łączy zdolności zrozumienia kontekstu rzeczywistego świata z precyzyjnym rysowaniem szczegółów przestrzennych. Model ten został opracowany z myślą o praktycznym zastosowaniu w produkcji, a nie tylko do demonstracyjnych przypadków użycia.

Architektura i zasada działania

Fundamentem FLUX.2 jest połączenie modelu Vision-Language Model (VLM) opartego na architekturze Mistral z transformerem o prostowanym przepływie (rectified flow transformer). VLM odpowiada za kontekst i wiedzę o rzeczywistości, podczas gdy transformer zajmuje się relacjami przestrzennymi, właściwościami materiałów i logiką kompozycji obrazu. To rozdzielenie ról pozwala modelowi osiągać zarówno fotorealistyczne detale, jak i prawidłowe zrozumienie instrukcji użytkownika.

Zmiana kluczowa w stosunku do poprzedników dotyczy latentnej przestrzeni – zespół naukowców ponownie przeszkolił autoenkoder wariacyjny (VAE) od podstaw. To posunięcie rozwiązuje tzw. “trylemat uczelniowalności-jakości-kompresji”, osiągając lepszą jakość obrazu przy tej samej zdolności do uczenia się.

Kluczowe funkcjonalności praktyczne

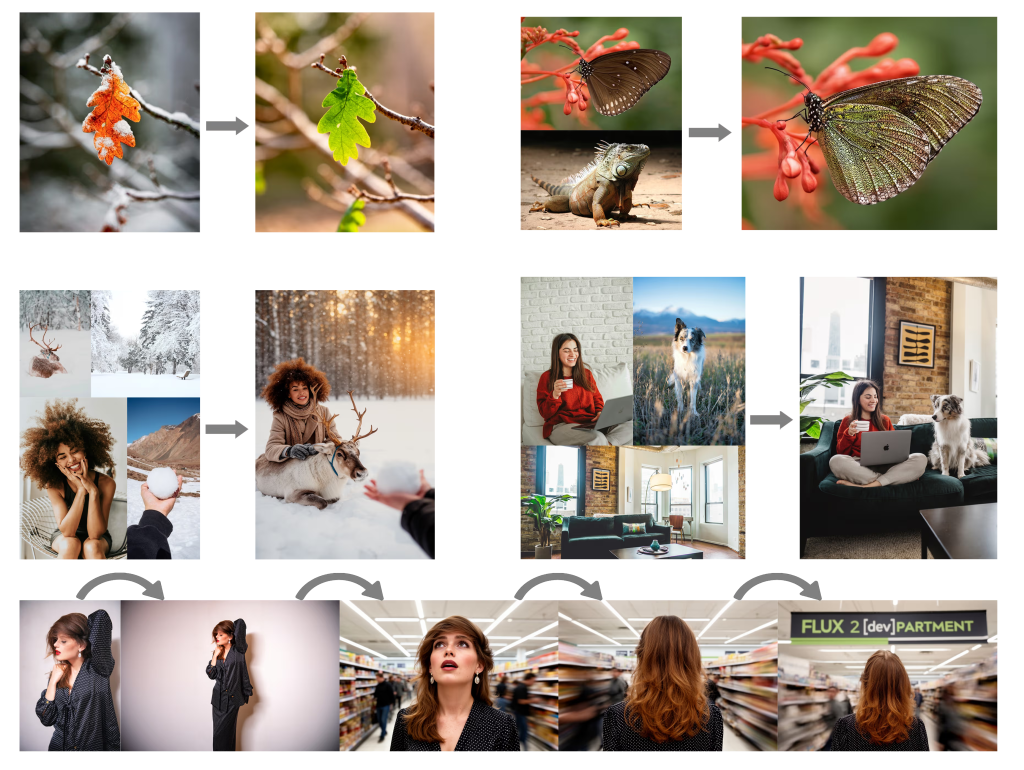

FLUX.2 oferuje szereg możliwości dedykowanych dla profesjonalnych przepływów pracy. Wyróżnia się obsługą wsparcia dla wielu obrazów referencyjnych – użytkownik może jednocześnie wykorzystać do 10 obrazów jako referencje, a model utrzyma spójność postaci, produktów i stylu. To rozwiązuje problem “stochastycznego dryftu”, gdzie wygenerowane obrazy tracą zgodność z materiałem źródłowym.

Edycja obrazów odbywa się z rozdzielczością do 4 megapikseli, co umożliwia pracę z dużymi formatami bez utraty detali. Model znacząco poprawił zdolności w renderowaniu tekstu – infografiki, makiety interfejsów użytkownika i treści wielojęzyczne są teraz generowane z czytelnymi czcionkami.

Inna istotna funkcja to prompt adherence – zdolność ścisłego przestrzegania złożonych, strukturalnych instrukcji. Model rozumie wieloczęściowe polecenia i ograniczenia kompozycyjne, co otwiera możliwość dla zaawansowanych użytkowników precyzyjnego kontrolowania wygenerowanego wyniku poprzez JSON-owe prompty lub specify konkretne kody kolorów.

| Wariant modelu | Parametry | Zastosowanie |

|---|---|---|

| FLUX.2 [pro] | Zaawansowany | Produkcja – API i playground, szybka generacja wysokiej jakości |

| FLUX.2 [flex] | Regulowana złożoność | Kontrola parametrów (liczba kroków, skala guidance), pełna elastyczność |

| FLUX.2 [dev] | 32 miliardów | Otwarte wagi – badania i eksperymentowanie lokalne, uruchamianie na RTX 4090 |

| FLUX.2 [klein] | Zmniejszone | Open-source (Apache 2.0), lżejsza alternatywa – wkrótce |

Zastosowania w rzeczywistych projektach

Potencjał FLUX.2 sięga poza tradycyjne zastosowania artystyczne. W e-commerce fotorealistyczne szczegóły, prawidłowe oświetlenie i zachowanie tekstur tkanin otwierają możliwość generowania profesjonalnych zdjęć produktów. W branży projektowania graficznego – od opakowania po materiały marketingowe – model oferuje bezprecedensową zdolność do zachowania identyfikacji wizualnej firmy i logotypów podczas edycji.

Dla deweloperów integrujących model w aplikacjach, dostępne są optymalizacje – wersje kwantowane FP8 zmniejszają wymagania pamięci o 40% przy jednoczesnym wzroście wydajności. Integracja z popularnymi narzędziami jak ComfyUI upraszcza deployment bez potrzeby dodatkowych pakietów oprogramowania.

Podejście open-source a dostępność

Black Forest Labs przyznaje się do strategii “open core” – łączenia otwartych, inspektowalnych modeli dla badaczy i artystów z produkcyjnymi API dla zespołów wymagających skalowania i niezawodności. FLUX.2 [dev] z otwartymi wagami dostępny jest na Hugging Face, podczas gdy wersje profesjonalne funkcjonują poprzez API i partnerstw (między innymi Cloudflare, FAL, Replicate). To podejście wyrównuje szanse dostępu do technologii frontierowej – od hobbyisty eksperymentującego na lokalnej karcie graficznej do dużych studiów produkcyjnych.

Wizualna inteligencja powinna być kształtowana przez badaczy, twórców i deweloperów wszędzie, nie tylko przez nielicznych. FLUX.2 to krok w kierunku modeli multimodalnych, które uniflikują percepcję, generowanie, pamięć i rozumowanie – otwarcie i przejrzyście.