- Dlaczego klasyfikacja ryzyka jest podstawą zgodności

- Poziom 1: Ryzyko nieakceptowalne – systemy całkowicie zakazane

- Poziom 2: Wysokie ryzyko – rygorystyczna zgodność obowiązkowa

- Poziom 3: Ograniczone ryzyko – przejrzystość jako główny obowiązek

- Poziom 4: Minimalne lub zerowe ryzyko – brak obowiązków

- Przegląd czterech poziomów w tabeli

- Drzewo decyzyjne: do której kategorii należy mój system?

- Praktyczne zastosowania klasyfikacji

- Źródła

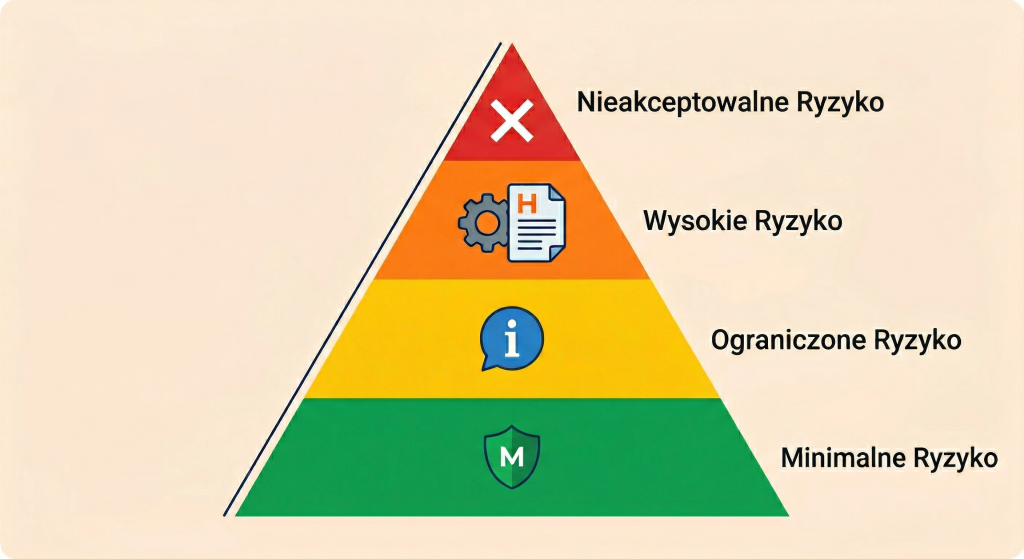

Rozporządzenie Parlamentu Europejskiego i Rady (UE) 2024/1689, znane jako AI Act, weszło w życie 1 sierpnia 2024 roku i wprowadza pierwsze na świecie kompleksowe ramy prawne dla systemów sztucznej inteligencji. Centralnym elementem całej regulacji jest podejście oparte na ryzyku: im większy potencjał szkody, tym bardziej rygorystyczne wymagania. Kluczem do zrozumienia tego mechanizmu jest klasyfikacja, która dzieli systemy AI na cztery poziomy ryzyka: nieakceptowalne, wysokie, ograniczone i minimalne.

Dlaczego klasyfikacja ryzyka jest podstawą zgodności

AI Act nie traktuje wszystkich systemów AI jednakowo. Regulator wychodzi z założenia, że filtr antyspamowy w skrzynce e-mail i algorytm oceniający wnioski kredytowe to zupełnie inne kategorie ryzyka i nakładanie na nie tych samych obowiązków byłoby zarówno nieproporcjonalne, jak i kontrproduktywne. Każda z czterech kategorii uruchamia inny zestaw obowiązków – od całkowitego zakazu użytkowania, przez rozbudowane oceny zgodności, po dobrowolne kodeksy postępowania. Błędna klasyfikacja może skutkować karami finansowymi sięgającymi 35 milionów euro lub 7% globalnego rocznego obrotu.

Poziom 1: Ryzyko nieakceptowalne – systemy całkowicie zakazane

To najwyższa kategoria ryzyka, obejmująca systemy, które są niezgodne z fundamentalnymi wartościami UE i prawami człowieka – i z tego powodu zakazane w całości. Zakazy weszły w życie 2 lutego 2025 roku i nie obowiązuje żaden okres przejściowy. Jeśli Twoja organizacja wciąż korzysta z jednej z takich aplikacji, musi ją natychmiast wyłączyć.

Do tej kategorii należą:

- Systemy social scoringu – rządowe platformy oceniające zachowanie społeczne obywateli i przyznające im punkty wpływające na dostęp do usług, zatrudnienia lub edukacji (model wzorowany na chińskim systemie zaufania społecznego).

- Manipulacja podprogowa – systemy oddziałujące na zachowanie ludzi technikami działającymi poniżej progu świadomości, np. ukryte komunikaty wbudowane w interfejs aplikacji skierowanej do dzieci.

- Exploitowanie podatności – aplikacje celowo wykorzystujące wiek, niepełnosprawność lub trudną sytuację ekonomiczną użytkownika do wpływania na jego decyzje na jego niekorzyść.

- Predykcyjne profilowanie kryminalne – algorytmy oceniające prawdopodobieństwo popełnienia przestępstwa wyłącznie na podstawie cech osobowościowych lub profilu demograficznego, bez zaistniałego zdarzenia.

- Biometryczna kategoryzacja wrażliwych atrybutów – systemy inferujące z danych biometrycznych rasę, poglądy polityczne, przynależność do związków zawodowych, przekonania religijne czy orientację seksualną.

- Rozpoznawanie emocji w miejscu pracy i szkołach – kamery lub oprogramowanie wykrywające emocje pracowników albo uczniów w celu oceny ich zaangażowania lub produktywności (z wyjątkami dla zastosowań medycznych i bezpieczeństwa).

- Real-time biometryczna identyfikacja w przestrzeni publicznej – systemy rozpoznawania twarzy działające w czasie rzeczywistym w miejscach publicznie dostępnych, stosowane przez organy ścigania bez wymaganego wyjątku prawnego.

Warto odnotować, że prawo przewiduje wąskie wyjątki dla organów ścigania w przypadkach poszukiwań zaginionych dzieci, zapobiegania bezpośrednim zagrożeniom terrorystycznym lub wykrywania poważnych przestępstw – jednak wymagają one uprzedniej autoryzacji sądowej lub administracyjnej.

Poziom 2: Wysokie ryzyko – rygorystyczna zgodność obowiązkowa

Systemy wysokiego ryzyka to aplikacje, które mogą wywierać istotny wpływ na zdrowie, bezpieczeństwo lub prawa podstawowe osób fizycznych. Nie są zakazane, ale objęte są najbardziej rozbudowanymi wymaganiami ze wszystkich dozwolonych kategorii. Termin wdrożenia obowiązków dla dostawców systemów z Załącznika III to 2 sierpnia 2026 roku.

Kategoria wysokiego ryzyka dzieli się na dwie grupy:

Grupa A – komponenty bezpieczeństwa produktów regulowanych (Załącznik I): systemy AI zintegrowane z urządzeniami medycznymi, maszynami przemysłowymi, systemami lotniczymi, motoryzacyjnymi czy kolejowymi. Przykładowo – algorytm wspomagający diagnozowanie obrazów RTG zintegrowany z urządzeniem medycznym klasy II podlega jednocześnie regulacjom o wyrobach medycznych i AI Act.

Grupa B – systemy z Załącznika III:

- Biometria: systemy zdalnej identyfikacji biometrycznej, kategoryzacji biometrycznej oraz rozpoznawania emocji (w zakresie dozwolonym prawem).

- Infrastruktura krytyczna: zarządzanie ruchem drogowym, sieci energetyczne, systemy wodociągowe – AI odpowiedzialne za decyzje operacyjne w tych obszarach.

- Edukacja: systemy oceniające uczniów i decydujące o dostępie do instytucji edukacyjnych lub przydziale do klas.

- Zatrudnienie: narzędzia rekrutacyjne filtrujące CV, systemy monitorowania wydajności pracowników, oprogramowanie do ocen pracowniczych.

- Dostęp do usług publicznych i prywatnych: scoring kredytowy, systemy oceny ryzyka ubezpieczeniowego, weryfikacja zdolności do spłaty pożyczki.

- Ściganie przestępstw: narzędzia oceny wiarygodności zeznań, poligrafy oparte na AI, systemy analizy dowodów.

- Migracja i azyl: systemy oceny ryzyka ucieczki, weryfikacja dokumentów, analiza wniosków azylowych.

- Wymiar sprawiedliwości: narzędzia wspomagające decyzje sądowe lub prognozujące wyroki.

Obowiązki dostawców systemów wysokiego ryzyka obejmują m.in.: utrzymanie systemu zarządzania ryzykiem przez cały cykl życia produktu, zarządzanie danymi treningowymi pod kątem reprezentatywności i braku błędów, prowadzenie dokumentacji technicznej, automatyczne logowanie zdarzeń, zapewnienie nadzoru ludzkiego oraz rejestrację systemu w unijnej bazie danych przed wprowadzeniem na rynek.

Poziom 3: Ograniczone ryzyko – przejrzystość jako główny obowiązek

Systemy z tej kategorii nie wymagają oceny zgodności ani rejestracji, ale muszą spełniać wymogi przejrzystości – użytkownik musi wiedzieć, że wchodzi w interakcję z AI. Termin wdrożenia tych obowiązków to 2 sierpnia 2026 roku.

Praktyczne przykłady systemów z ograniczonym ryzykiem:

- Chatboty i wirtualni asystenci – każda aplikacja konwersacyjna udająca człowieka musi w wyraźny i czytelny sposób poinformować użytkownika, że rozmawia z AI.

- Generatory deepfake – systemy tworzące realistyczne obrazy, wideo lub dźwięk z wizerunkiem prawdziwych osób muszą oznaczać takie treści jako sztucznie wygenerowane.

- Modele generatywne AI (poza progiem systemowym) – duże modele językowe i systemy generowania obrazów wymagają ujawnienia, kiedy treść jest generowana przez AI. Modele przekraczające próg obliczeniowy 10^25 FLOP podlegają dodatkowo obowiązkom charakterystycznym dla wyższego ryzyka.

- Systemy rozpoznawania emocji poza zakazanym zakresem – aplikacje wykrywające emocje w kontekstach innych niż szkoła czy miejsce pracy muszą poinformować osobę badaną o stosowaniu takiej technologii.

Poziom 4: Minimalne lub zerowe ryzyko – brak obowiązków

Zdecydowana większość systemów AI w użyciu komercyjnym należy do tej kategorii – szacuje się, że obejmuje ona ponad 80% wszystkich aplikacji AI dostępnych na rynku. Nie wiążą się z nią żadne obowiązkowe wymogi regulacyjne, choć regulacja zachęca do dobrowolnego stosowania kodeksów postępowania i etycznych zasad AI.

Przykłady systemów z minimalnym ryzykiem:

- Filtry antyspamowe w systemach pocztowych

- Algorytmy rekomendacyjne w grach wideo

- Systemy zarządzania zapasami magazynowymi

- Asystenci AI do planowania tras w aplikacjach nawigacyjnych

- Algorytmy optymalizacji zużycia energii w budynkach

- Narzędzia do korekty ortograficznej i gramatycznej

Przegląd czterech poziomów w tabeli

| Poziom ryzyka | Status | Przykłady | Główne obowiązki | Kara za naruszenie |

|---|---|---|---|---|

| Nieakceptowalne | Zakazane | Social scoring, predykcyjny profiling kryminalny, manipulacja podprogowa | Zakaz użytkowania | Do 35 mln EUR / 7% obrotu |

| Wysokie | Dozwolone z warunkami | Scoring kredytowy, systemy rekrutacyjne, AI medyczne, zarządzanie infrastrukturą | Ocena zgodności, dokumentacja techniczna, rejestracja w EU DB, nadzór ludzki | Do 15 mln EUR / 3% obrotu |

| Ograniczone | Dozwolone z warunkami | Chatboty, deepfake, modele generatywne | Informowanie użytkownika o interakcji z AI | Do 7,5 mln EUR / 1,5% obrotu |

| Minimalne | Dozwolone bez ograniczeń | Filtry spamu, gry wideo, rekomendacje produktów | Brak obowiązkowych wymogów | Brak |

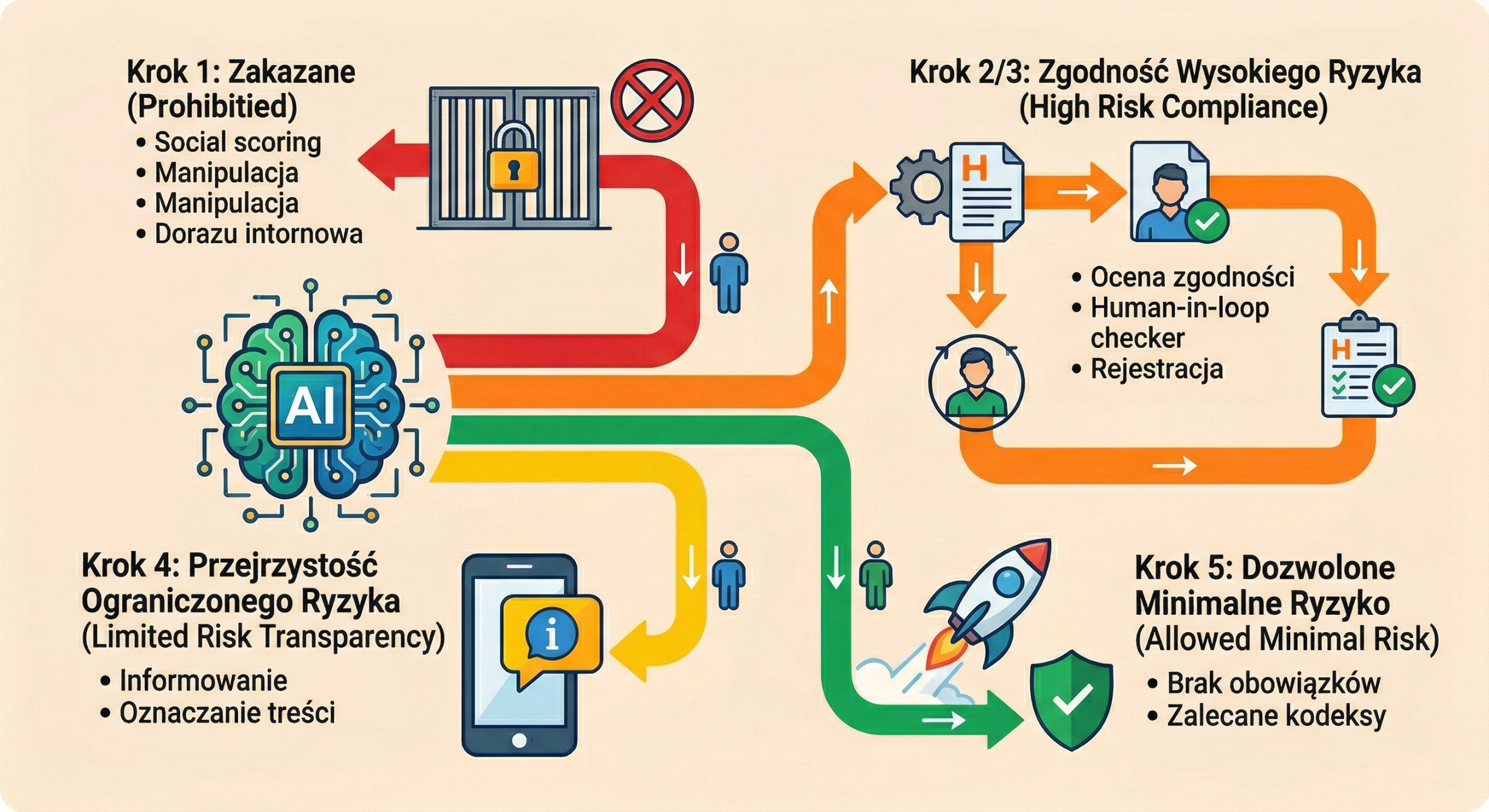

Drzewo decyzyjne: do której kategorii należy mój system?

Poniższy schemat krok po kroku pozwala samodzielnie wstępnie ocenić, w której kategorii ryzyka AI Act mieści się Twój system. Klasyfikacja powinna być następnie zweryfikowana przez prawnika lub specjalistę ds. zgodności, szczególnie w przypadkach granicznych.

Krok 1: Czy system mieści się w kategorii zakazanej?

Sprawdź, czy Twój system realizuje którykolwiek z poniższych celów:

- Social scoring obywateli przez organy publiczne lub prywatne

- Manipulacja podprogowa zachowaniem ludzkim

- Exploitowanie podatności grup szczególnie wrażliwych

- Biometryczna kategoryzacja wrażliwych atrybutów (rasa, poglądy polityczne, orientacja seksualna itd.)

- Predykcyjne profilowanie kryminalne wyłącznie na podstawie cech osobowościowych

- Rozpoznawanie emocji w miejscu pracy lub szkole (bez wyjątków bezpieczeństwa/medycznych)

- Identyfikacja biometryczna w czasie rzeczywistym w przestrzeni publicznej przez organy ścigania bez autoryzacji

➡ TAK → System jest zakazany. Należy go natychmiast wyłączyć.

➡ NIE → Przejdź do Kroku 2.

Krok 2: Czy system jest komponentem bezpieczeństwa produktu regulowanego lub samym takim produktem?

Sprawdź, czy system AI jest wbudowany w urządzenie medyczne, maszynę przemysłową, pojazd, sprzęt lotniczy lub kolejowy objęty unijnym prawodawstwem harmonizacyjnym z Załącznika I AI Act.

➡ TAK → System jest wysokiego ryzyka. Wymagana ocena zgodności i rejestracja.

➡ NIE → Przejdź do Kroku 3.

Krok 3: Czy system jest wymieniony w Załączniku III?

Sprawdź, czy aplikacja dotyczy któregoś z obszarów: biometria, infrastruktura krytyczna, edukacja, zatrudnienie, dostęp do podstawowych usług prywatnych i publicznych, ściganie przestępstw, migracja i azyl, wymiar sprawiedliwości.

➡ TAK → System jest wysokiego ryzyka. Wdróż pełen pakiet obowiązków z Artykułów 9–15 AI Act.

➡ NIE → Przejdź do Kroku 4.

Krok 4: Czy system wchodzi w interakcję z ludźmi, generuje treści lub syntetyczne dane?

Sprawdź, czy system to chatbot udający człowieka, generator obrazów/wideo/dźwięku, model językowy lub inny system generatywny AI.

➡ TAK → System ma ograniczone ryzyko. Obowiązuje informowanie użytkowników i oznaczanie treści generowanych przez AI.

➡ NIE → Przejdź do Kroku 5.

Krok 5: Brak dopasowania do wyższych kategorii

System należy do kategorii minimalnego ryzyka. Nie ma obowiązkowych wymogów regulacyjnych, ale warto rozważyć dobrowolne stosowanie etycznych zasad AI i kodeksów postępowania.

Ważna uwaga praktyczna: gdy system pełni jednocześnie funkcje z różnych kategorii ryzyka (np. chatbot zintegrowany z systemem oceny zdolności kredytowej), AI Act nakazuje zastosowanie najwyższej mającej zastosowanie kategorii – czyli w tym przykładzie wysokiego ryzyka.

Praktyczne zastosowania klasyfikacji

Pierwszym krokiem w każdej organizacji wdrażającej AI powinna być inwentaryzacja wszystkich systemów AI – zarówno własnych, jak i zewnętrznych narzędzi SaaS (np. subskrypcje ChatGPT Enterprise czy Copilot for Microsoft 365 są deploymentem AI w rozumieniu AI Act). Dla każdego zidentyfikowanego systemu należy przeprowadzić klasyfikację ryzyka z udokumentowanym uzasadnieniem – ta dokumentacja będzie podstawą do ewentualnej kontroli przez organ nadzorczy. Systemy wysokiego ryzyka wymagają priorytetowego potraktowania: ocena zgodności, dokumentacja techniczna i rejestracja w bazie EU muszą być gotowe do 2 sierpnia 2026 roku.

W przypadku systemów granicznych – gdy nie wiadomo, czy dane zastosowanie kwalifikuje się jako wysokie ryzyko w Załączniku III – rekomendowane podejście to traktowanie go jako wysokiego ryzyka do czasu uzyskania wiążącej interpretacji lub opublikowania przez Komisję Europejską szczegółowych wytycznych. Takie ostrożne podejście chroni organizację przed zarzutem nieumyślnego wdrożenia niezgodnego systemu i demonstruje dobrą wiarę w razie kontroli. Warto też śledzić aktywność Europejskiego Urzędu ds. AI (AI Office), który sukcesywnie wydaje wytyczne interpretacyjne do poszczególnych zapisów rozporządzenia.

Źródła

- AuditFront: EU AI Act Compliance Guide – Risk Classification, Requirements and Timeline

- GDPR Local: AI Risk Classification – Guide to EU AI Act Risk Categories

- Wikipedia: Artificial Intelligence Act

- Trail ML: EU AI Act – How risk is classified

- CRIDO: Kwalifikacja systemów zgodnie z AI Act

- PBSG: AI Act – jak klasyfikowane jest ryzyko?

- Wolters Kluwer: Podział systemów AI zgodnie z AI Act

- Komisja Europejska: AI Act – oficjalna strona

- DSS: Demystifying the EU AI Act – Understanding AI Risk Categories

- XpertDPO: Understanding Minimal and Limited Risk under the EU AI Act