- Podstawy konteneryzacji dla modeli AI

- Docker Model Runner: nowe podejście do uruchamiania modeli

- Główne różnice między Docker Model Runner a tradycyjnymi kontenerami

- Orkiestracja AI z Kubernetes

- Wyzwania w zarządzaniu GPU w Kubernetes

- Best practices dla obciążeń AI w kontenerach

- Zarządzanie trwałością danych dla modeli AI

- Monitorowanie kontenerów AI

- Wersjonowanie modeli w kontenerach

- Narzędzia i platformy dla AI na Kubernetes

- Źródła

Wdrażanie modeli sztucznej inteligencji w środowiskach produkcyjnych stanowi jedno z największych wyzwań współczesnych zespołów DevOps i MLOps. Według raportu Gartner z 2025 roku, aż 85 % modeli uczenia maszynowego nigdy nie trafia do produkcji, głównie z powodu niespójnych przepływów pracy i problemów z wdrożeniem. Docker i konteneryzacja oferują rozwiązanie tego problemu, zapewniając powtarzalność, izolację i przenośność środowisk AI.

Podstawy konteneryzacji dla modeli AI

Konteneryzacja w kontekście AI polega na pakowaniu modelu wraz z wszystkimi zależnościami, bibliotekami i konfiguracjami w jedną przenośną jednostkę. Dzięki temu model działa identycznie w każdym środowisku, od laptopa dewelopera po klaster produkcyjny w chmurze. Docker stał się de facto standardem, osiągając ponad 13 miliardów pobrań kontenerów miesięcznie w 2025 roku.

W tradycyjnym podejściu kontenery Docker przechowują duże modele AI wraz z runtime’em, co prowadzi do wolnych wdrożeń i nadmiarowego wykorzystania przestrzeni dyskowej. Gdy używamy standardowych obrazów Docker, pliki są przechowywane w skompresowanym formacie, a podczas wykonywania docker pull obraz jest dekompresowany na lokalnym dysku, często podwajając wymagania dotyczące przestrzeni dyskowej. Problem pogłębia się w przypadku modeli AI, które składają się z wag matematycznych, liczb, które nie uzyskują korzyści z kompresji.

Docker Model Runner: nowe podejście do uruchamiania modeli

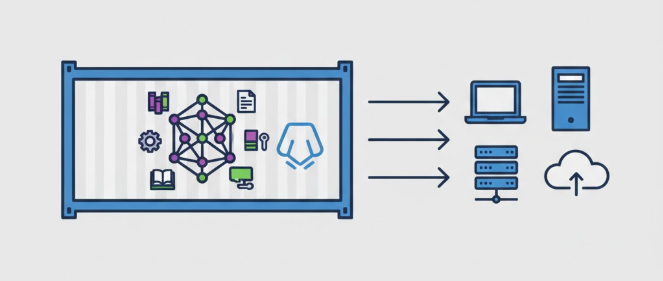

Docker przedstawił w 2025 roku Docker Model Runner, eksperymentalną funkcję, która radykalnie zmienia sposób uruchamiania dużych modeli językowych lokalnie. W przeciwieństwie do tradycyjnych kontenerów Docker, Model Runner stosuje hybrydowe podejście architektoniczne, które łączy możliwości orkiestracji Docker z natywną wydajnością hosta dla inferencji AI.

Kluczowa różnica polega na tym, że model AI NIE działa w kontenerze. Zamiast tego Docker Model Runner wykorzystuje serwer inferencji zainstalowany na hoście (obecnie llama.cpp), który działa bezpośrednio na maszynie gospodarza. Proces natywny działa poza środowiskiem kontenerowym, a wagi modelu są ładowane przez ten proces hosta w razie potrzeby. Takie architektoniczne rozwiązanie znacząco poprawia wydajność, eliminując narzut konteneryzacji dla zasobochłonnych obciążeń AI.

Główne różnice między Docker Model Runner a tradycyjnymi kontenerami

Różnice między Docker Model Runner a tradycyjnymi kontenerami są fundamentalne w kilku kluczowych obszarach. Po pierwsze, miejsce wykonania: tradycyjne kontenery uruchamiają model w izolowanym środowisku kontenerowym, podczas gdy Model Runner uruchamia silnik inferencji bezpośrednio na hoście. Po drugie, dostęp do GPU: Model Runner zapewnia bezpośredni dostęp do Metal API na procesorach Apple Silicon lub CUDA bez warstw wirtualizacji, co przekłada się na maksymalną akcelerację GPU.

Trzecim istotnym aspektem jest zarządzanie przechowywaniem modeli. Modele są obsługiwane jako artefakty OCI, a nie obrazy kontenerów. Gdy wykonujesz polecenie docker model pull, pliki modelu są pobierane z Docker Hub i przechowywane lokalnie na dysku hosta. Silnik inferencji na poziomie hosta dynamicznie ładuje te pliki do pamięci w razie potrzeby. To podejście jest szczególnie korzystne, ponieważ wagi modeli są w dużej mierze niekompresowalne, unika się przechowywania zarówno skompresowanych, jak i nieskompresowanych wersji wag na dysku oraz zapewnia szybsze wdrażanie poprzez eliminację cyklu budowania/uruchamiania kontenera.

Docker Model Runner integruje się z ekosystemem Docker poprzez natywne komendy (docker model pull, docker model run, docker model package), oferuje API kompatybilne z OpenAI, umożliwiając prostą integrację z istniejącym kodem, oraz wspiera format GGUF dla popularnych skwantyzowanych formatów modeli. Dodatkowo zapewnia bezproblemową integrację z Docker Compose i Testcontainers.

Orkiestracja AI z Kubernetes

Kubernetes stał się fundamentem nowoczesnej infrastruktury AI, zapewniając orkiestrację, która przekształca sposób organizacji rozwijania, trenowania i wdrażania modeli AI. W 2025 roku Kubernetes obsługuje wszystko – od lekkich usług inferencyjnych po masywne, rozproszone potoki treningowe w klastrach przyspieszanych przez GPU.

Kubernetes doskonale radzi sobie z zarządzaniem różnorodnymi wymaganiami zasobowymi aplikacji AI poprzez swoje mechanizmy przydziału zasobów i limitów. Umożliwia automatyczne przydzielanie zasobów GPU do zadań treningowych uczenia maszynowego, skalowanie CPU i pamięci w oparciu o zapotrzebowanie na inferencję, implementację dzielenia zasobów między wieloma zespołami i projektami AI oraz zapewnienie gwarancji jakości usług dla krytycznych obciążeń AI.

Jedną z największych zalet Kubernetes w dziedzinie AI jest zdolność do automatycznego skalowania aplikacji w oparciu o zapotrzebowanie. Horizontal Pod Autoscaler (HPA) i Vertical Pod Autoscaler (VPA) umożliwiają automatyczne skalowanie serwerów inferencji w oparciu o wolumen żądań, dynamiczne dostosowywanie zasobów dla zadań treningowych, optymalizację kosztów poprzez inteligentne przydzielanie zasobów oraz równoważenie obciążenia między wieloma instancjami modelu.

Wyzwania w zarządzaniu GPU w Kubernetes

Tradycyjny model przydzielania GPU w Kubernetes wykorzystuje prosty schemat oparty na liczbach całkowitych. Pody żądają GPU poprzez żądania zasobów takie jak nvidia.com/gpu: 1, scheduler traktuje GPU jako nieprzezroczyste urządzenia typu black‑box, każde obciążenie otrzymuje wyłączny dostęp do całego GPU, niezależnie od rzeczywistych potrzeb, a brak świadomości zużycia pamięci, wykorzystania obliczeń czy topologii GPU.

Ten model jest fundamentalnie niedopasowany do różnorodnych i dynamicznych wymagań współczesnych obciążeń AI. Wiele zadań inferencyjnych wymaga zaledwie ułamka zasobów GPU, czasami wystarczy 2‑4 GB pamięci GPU. Jednak w tradycyjnym modelu te zadania otrzymują całe GPU o dużej pojemności, jak 80 GB A100, pozostawiając większość zasobów GPU w stanie bezczynności.

Aby zoptymalizować wykorzystanie, dostępne są zaawansowane funkcje: Multi‑Instance GPU (MIG) dzieli fizyczne GPU na wiele niezależnych instancji (do siedmiu, w zależności od GPU), z własnymi dedykowanymi zasobami. vGPU (Virtual GPU) umożliwia wielu maszynom wirtualnym bezpośredni dostęp do pojedynczego GPU, ale wymaga obsługiwanego hiperwizora i licencjonowania NVIDIA AI Enterprise. GPU Time‑Slicing to mechanizm, w którym fizyczne GPU jest współdzielone między wieloma obciążeniami poprzez szybkie przełączanie kontekstów wykonania.

Best practices dla obciążeń AI w kontenerach

Implementacja skutecznych praktyk dla konteneryzacji AI wymaga przemyślanego podejścia na wielu poziomach. Pierwszym krokiem jest wykorzystanie wieloetapowych buildów Docker (multi‑stage builds), które pozwalają na tworzenie zoptymalizowanych obrazów kontenerów poprzez redukcję rozmiaru i zwiększenie bezpieczeństwa. Każdy etap może służyć innemu celowi, można selektywnie kopiować artefakty z jednego etapu do następnego, pozostawiając wszystko, czego nie potrzebujesz w końcowym obrazie.

Typowy wieloetapowy build dla aplikacji AI składa się z etapu budowania, który używa pełnego obrazu bazowego z narzędziami kompilacji, instaluje zależności developerskie oraz kompiluje kod lub przygotowuje model. Następnie etap produkcyjny wykorzystuje lekki obraz bazowy (np. alpine lub slim), kopiuje tylko skompilowane artefakty i runtime’owe zależności oraz wyklucza narzędzia budowania i wrażliwe dane.

Zarządzanie zasobami w kontenerach Docker jest kluczowe dla utrzymania stabilnego, responsywnego środowiska. Limity pamięci (--memory) pomagają zapobiegać błędom braku pamięci (OOM), podczas gdy udziały CPU (--cpu‑shares) zapewniają, że kontenery o wysokim priorytecie zachowują responsywność. Limity CPU można ustawić poprzez parametr --cpus, który określa maksymalną liczbę CPU, jaką może wykorzystać kontener.

W kontekście Kubernetes, najlepsze praktyki obejmują wykorzystanie przestrzeni nazw (namespaces) do izolacji obciążeń, oddzielając środowiska deweloperskie, testowe i produkcyjne AI. Implementacja limitów zasobów i żądań zapobiega sytuacji, w której zasobożerne zadania AI wpływają na inne obciążenia. Wykorzystanie node affinity dla umieszczania obciążeń zapewnia, że zadania intensywnie wykorzystujące GPU są uruchamiane na odpowiednim sprzęcie. Włączenie horizontal pod autoscaling umożliwia automatyczne dostosowywanie zasobów w oparciu o zapotrzebowanie, a monitorowanie wydajności za pomocą wbudowanych narzędzi obserwacji śledzi metryki specyficzne dla obciążeń AI.

Zarządzanie trwałością danych dla modeli AI

Aplikacje AI generują dwa rodzaje danych: trwałe i nietrwałe. Dane nietrwałe można zignorować i nie muszą być nigdzie zapisywane. Z drugiej strony, dane trwałe muszą być zachowane do przyszłego użycia, nie mogą zostać utracone za żadną cenę. Docker oferuje wolumeny (volumes) jako preferowany mechanizm utrwalania danych generowanych i używanych przez kontenery Docker.

Wolumeny są łatwiejsze w tworzeniu kopii zapasowych lub migracji niż bind mounts. Można zarządzać nimi za pomocą poleceń Docker CLI lub Docker API. Wolumeny działają zarówno na kontenerach Linux, jak i Windows, mogą być bezpiecznie udostępniane między wieloma kontenerami, a nowe wolumeny mogą mieć zawartość wstępnie wypełnioną przez kontener lub build.

W kontekście Kubernetes dla stanowych obciążeń AI, StatefulSets zapewniają stabilne, unikalne identyfikatory sieciowe, stabilną, trwałą pamięć masową, uporządkowane, płynne wdrażanie i skalowanie oraz uporządkowane, zautomatyzowane aktualizacje kroczące. StatefulSet utrzymuje lepką tożsamość dla każdego ze swoich podów, co ułatwia dopasowanie istniejących wolumenów do nowych podów, które zastępują te, które uległy awarii.

Monitorowanie kontenerów AI

Prometheus szybko stał się narzędziem do monitorowania Docker i Kubernetes. Wielowymiarowy model danych oparty na parach klucz‑wartość, podobnie jak Kubernetes organizuje metadane infrastruktury za pomocą etykiet, pozwala na elastyczne i dokładne dane szeregów czasowych. Metryki są czytelne dla człowieka, w samoobjaśniającym formacie i publikowane przy użyciu standardowego transportu HTTP.

Do monitorowania klastra Kubernetes z obciążeniami AI wykorzystuje się kilka komponentów: cAdvisor to agent analizy użycia zasobów kontenera i wydajności, który działa jako część binarki Kubelet. Kube‑state‑metrics to prosta usługa nasłuchująca serwera API Kubernetes i generująca metryki o stanie obiektów, takich jak wdrożenia, węzły i pody. Metrics‑server to agregator danych o użyciu zasobów w całym klastrze, skupiający się na implementacji API metryk zasobów: CPU, deskryptory plików, pamięć, opóźnienia żądań.

Wersjonowanie modeli w kontenerach

Wersjonowanie jest niezbędne w kontenerach ML w celu zapewnienia odtwarzalności i spójności. Należy określić dokładne wersje bibliotek oprogramowania, zależności i modeli używanych w kontenerze, aby uniknąć problemów ze zgodnością. Kluczowe jest wykorzystanie technologii konteneryzacji, takich jak Docker i Kubernetes, do pakowania modeli ML, co zapewnia przenośność, spójność i bezpieczeństwo.

Najlepsze praktyki obejmują ustanowienie strategii wersjonowania modeli na wczesnym etapie, automatyzację procesu wersjonowania dla skalowalności oraz wykorzystanie spójnych konwencji nazewnictwa. Docker Model Runner pakuje modele jako artefakty OCI (Open Container Initiative), otwarty standard, który umożliwia dystrybucję i wersjonowanie ich poprzez te same rejestry i przepływy pracy, których już używasz dla kontenerów.

Narzędzia i platformy dla AI na Kubernetes

Kubeflow stanowi najbardziej komplekszną platformę do uruchamiania obciążeń uczenia maszynowego na Kubernetes. Kluczowe komponenty obejmują Kubeflow Pipelines do budowania i wdrażania przenośnych przepływów pracy ML, Katib do automatycznego dostrajania hiperparametrów i wyszukiwania architektury neuronowej, KFServing do serwowania modeli i inferencji oraz Training Operators do rozproszonego treningu TensorFlow, PyTorch i innych frameworków.

Specjalistyczne operatory rozszerzają możliwości Kubernetes dla AI: TensorFlow Operator zarządza zadaniami treningowymi TensorFlow, PyTorch Operator obsługuje rozproszony trening PyTorch, MPI Operator wspiera rozproszony trening oparty na MPI, a Volcano zapewnia zaawansowane planowanie wsadowe dla obciążeń AI. Skuteczne zarządzanie GPU jest kluczowe dla obciążeń AI na Kubernetes, a NVIDIA GPU Operator upraszcza zarządzanie GPU i ich monitorowanie.

Źródła

- Ultimate Docker Guide 2025: Join the Top 10 Developers

- Docker Model Runner: The Missing Piece for Your GenAI Development Workflow

- AI in Kubernetes | Explore

- What is Docker Model Runner and what problem does it solve?

- Kubernetes and AI: Mastering ML Workloads in 2025

- Deploy Machine Learning Models with Docker: A Practical Perspective

- How We Designed Docker Model Runner and What’s Next

- Kubernetes or Chaos: The Risks of Running AI Workloads Without Orchestration

- Introducing Docker Model Runner

- Docker Model Runner vs Ollama: Which to Choose?

- Why Kubernetes is Essential for AI Workloads

- Modern Docker Best Practices for 2025

- Model Deployment and Orchestration

- Rethinking GPU Allocation in Kubernetes

- The NVIDIA GPU Operator real‑world guide for Kubernetes AI

- AI/ML in Kubernetes Best Practices: The Essentials

- AI for docker: Seamless Magic 2025

- Deploying Machine Learning Models in Production with Kubernetes

- Multi‑Stage Builds in Docker

- The Future of AI/ML in Kubernetes: Trends and Best Practices

- Optimize Your AI Containers with Docker Multi‑Stage Builds

- Multi‑stage builds – Docker Documentation

- Docker Resource Limits: A Guide

- Machine Learning Model Versioning: Top Tools & Best Practices

- Implementing Docker Resource Management in Containers

- Schedule GPUs – Kubernetes Documentation

- Best Practices for Building Containers for Machine Learning

- Docker‑Guide‑for‑AI‑Model‑Development‑and‑Deployment

- Benchmarking a 65 000‑node GKE cluster with AI workloads

- Volumes – Docker Documentation

- Kubernetes monitoring with Prometheus, the ultimate guide

- StatefulSets – Kubernetes Documentation

- Deploy ML Model on Kubernetes with KServe

- Kubernetes GPU Resource Management Best Practices