Spis treści

- Stable Audio Open Small

- współpraca Microsoft i Hugging Face

- VS Code udostępnia kod rozszerzenia GitHub Copilot Chat

Stable Audio Open Small – generowanie dźwięku na urządzeniach mobilnych

Stability AI we współpracy z Arm udostępniło nowy model sztucznej inteligencji do generowania dźwięku na podstawie tekstu. Stable Audio Open Small to kompaktowa wersja swojego większego odpowiednika, zoptymalizowana do działania bezpośrednio na procesorach Arm, które napędzają 99% smartfonów na świecie.

Specyfikacja techniczna modelu

Stable Audio Open Small to model dyfuzyjny pracujący w przestrzeni latentnej, zbudowany w oparciu o architekturę transformera. W przeciwieństwie do swojego większego odpowiednika (Stable Audio Open z 1,1 miliarda parametrów), nowa wersja zawiera jedynie 341 milionów parametrów, co znacząco redukuje wymagania obliczeniowe bez istotnej utraty jakości generowanych dźwięków.

Model został zaprojektowany z myślą o generowaniu stereofonicznego dźwięku o częstotliwości 44,1 kHz. Jego główną zaletą jest szybkość – potrafi wygenerować do 11 sekund audio w czasie krótszym niż 8 sekund, działając wyłącznie na procesorze urządzenia mobilnego. Jest to możliwe dzięki bibliotekom KleidiAI firmy Arm, które optymalizują wykonywanie obliczeń na procesorach ARM.

Architektura modelu składa się z trzech głównych komponentów: autoenkodera kompresującego fale dźwiękowe do zarządzalnej długości sekwencji, osadzenia tekstowego opartego na T5 oraz transformerowego modelu dyfuzyjnego (DiT) operującego w przestrzeni latentnej autoenkodera.

Praktyczne zastosowania

Stable Audio Open Small jest szczególnie przydatny do generowania krótkich próbek audio, efektów dźwiękowych i elementów produkcyjnych na podstawie podpowiedzi tekstowych. Doskonale nadaje się do tworzenia pętli perkusyjnych, dźwięków foley, riffów instrumentalnych i tekstur ambientowych.

Kompaktowy rozmiar i szybkie wnioskowanie sprawiają, że model idealnie nadaje się do wdrożeń na urządzeniach mobilnych i brzegowych opartych na procesorach Arm, gdzie liczy się generowanie dźwięku w czasie rzeczywistym. To otwiera nowe możliwości dla mobilnych aplikacji muzycznych, narzędzi dla twórców treści czy gier wykorzystujących generatywne efekty dźwiękowe.

Dzięki przesunięciu obliczeń AI na urządzenia końcowe, twórcy aplikacji mogą zaoferować użytkownikom kreatywne narzędzia audio bez konieczności przesyłania danych do chmury, co przekłada się na większą prywatność i niższe koszty operacyjne.

Rozszerzona współpraca Microsoft i Hugging Face w ramach Azure AI Foundry

Azure AI Foundry to ujednolicona platforma Microsoft do tworzenia, oceniania i wdrażania rozwiązań sztucznej inteligencji. Podczas konferencji Microsoft Build, Satya Nadella ogłosił znaczące rozszerzenie współpracy z Hugging Face, które umożliwia łatwe wdrażanie tysięcy otwartych modeli AI na bezpiecznej infrastrukturze Azure.

Kluczowe aspekty nowej współpracy

Dzięki temu partnerstwu, Azure AI Foundry udostępnia obecnie ponad 10 000 modeli z kolekcji Hugging Face, które można wdrożyć zaledwie kilkoma kliknięciami. To znaczne rozszerzenie wcześniejszej współpracy sprzed dwóch lat, kiedy Hub Hugging Face zawierał około 200 000 modeli. Obecnie platforma oferuje dostęp do niemal 2 milionów otwartych modeli obsługujących różnorodne zadania, modalności i języki.

Aby zapewnić bezpieczeństwo i niezawodność korporacyjną, wszystkie modele w kolekcji Hugging Face na Azure AI Foundry spełniają rygorystyczne wymagania bezpieczeństwa. Przeszły one testy z użyciem narzędzi takich jak ProtectAI Guardian i skaner bezpieczeństwa JFrog. Dodatkowo, wagi modeli są przechowywane w formacie safetensors, co eliminuje potencjalne luki bezpieczeństwa związane z formatem Pickle, a modele nie zawierają kodu zdalnego, co zapobiega wstrzyknięciu dowolnego kodu podczas działania.

Proces wdrażania modeli

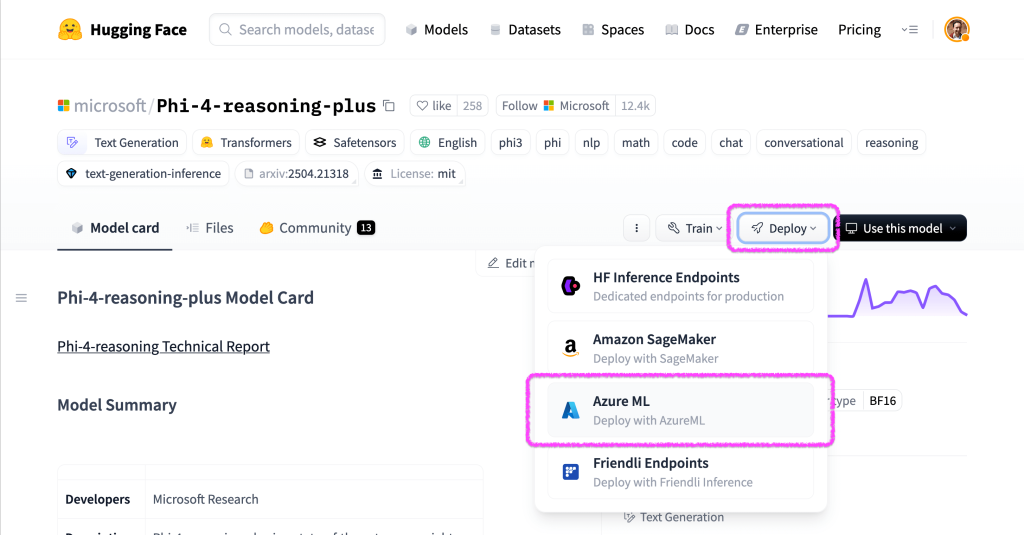

Wdrożenie modelu z kolekcji Hugging Face w Azure AI Foundry jest niezwykle proste. Wystarczy wybrać model z katalogu, kliknąć przycisk “Deploy”, wybrać parametry wirtualnej maszyny oraz wdrożenia, a następnie rozpocząć proces jednym kliknięciem. Alternatywnie można także rozpocząć od strony modelu na Hugging Face i skorzystać z opcji “Deploy on Azure ML”.

Praktyczne zastosowania i przyszły rozwój

Integracja modeli Hugging Face z Azure AI Foundry umożliwia firmom tworzenie zaawansowanych aplikacji AI przy zachowaniu pełnej kontroli nad swoją technologią i danymi. Modele te wspierają pracę z tekstem, dźwiękiem i obrazami, obsługując zadania takie jak generowanie tekstu, ekstrakcja cech, tłumaczenie, klasyfikacja obrazów czy rozpoznawanie mowy.

W najbliższym czasie Microsoft i Hugging Face planują kolejne udoskonalenia, w tym: wydania nowych modeli w trybie “Day-0” (dostępne tego samego dnia na Azure AI Foundry i Hugging Face), codzienne aktualizacje trendujących modeli, wsparcie dla nowych modalności (wideo, 3D, szeregi czasowe) oraz rozwój agentów i narzędzi opartych na małych, wyspecjalizowanych modelach open source.

VS Code udostępnia kod rozszerzenia GitHub Copilot Chat jako open source

W najnowszym ogłoszeniu z 19 maja 2025 roku, zespół Visual Studio Code potwierdził swoje zaangażowanie w rozwój edytora kodu jako projektu open source. VS Code, który przez ostatnią dekadę był jednym z najpopularniejszych projektów OSS na GitHubie, kontynuuje tę tradycję, otwierając kod rozszerzenia GitHub Copilot Chat na licencji MIT. Następnie kluczowe komponenty zostaną zrefaktoryzowane i włączone do rdzenia VS Code.

Dlaczego zdecydowano się na model open source?

Zespół VS Code wskazuje kilka kluczowych powodów tej decyzji. Przede wszystkim, duże modele językowe (LLM) znacząco się poprawiły, eliminując potrzebę stosowania zastrzeżonych strategii promptów. Popularne interfejsy użytkownika do interakcji z AI stały się już standardem wśród różnych edytorów kodu.

Ważnym czynnikiem był również dynamiczny rozwój ekosystemu open source’owych narzędzi AI i rozszerzeń do VS Code. Otwarte udostępnienie kodu Copilot Chat umożliwi autorom rozszerzeń łatwiejsze tworzenie, debugowanie i testowanie własnych projektów, co było trudne bez dostępu do kodu źródłowego.

Zwiększenie przejrzystości w zakresie zbieranych danych stanowi kolejny istotny argument. Użytkownicy będą mogli bezpośrednio sprawdzić, jakie dane są zbierane przez edytor AI, co buduje zaufanie do narzędzia.

Planowane działania

W najbliższych tygodniach zespół VS Code będzie pracował nad udostępnieniem kodu rozszerzenia GitHub Copilot Chat i refaktoryzacją funkcji AI do rdzenia VS Code. Celem jest utrzymanie wysokiej wydajności, możliwości rozbudowy i intuicyjnego interfejsu użytkownika.

Co istotne, twórcy VS Code planują również udostępnić infrastrukturę testową dla promptów, co pozwoli społeczności na łatwiejsze wnoszenie wkładu w rozwój funkcji opartych na AI. Jest to szczególnie ważne ze względu na stochastyczną naturę modeli językowych.

Praktyczne korzyści dla deweloperów

Otwarte udostępnienie kodu Copilot Chat przyniesie wymierne korzyści dla programistów. Społeczność będzie mogła aktywnie uczestniczyć w ulepszaniu funkcji AI, dostosowywać elementy interfejsu i tworzyć nowe rozszerzenia bazujące na technologii Copilot.

Dla twórców narzędzi i rozszerzeń dostęp do kodu źródłowego oznacza możliwość głębszego zrozumienia działania asystenta AI, co powinno przełożyć się na powstawanie bardziej zaawansowanych i zintegrowanych rozwiązań dla całego ekosystemu VS Code.

Źródła

- Stability AI and Arm Collaborate to Release Stable Audio Open Small

- Model Stable Audio Open Small na Hugging Face

- Stable Audio Open – arXiv

- Microsoft and Hugging Face expand collaboration to make open models easy to use on Azure

- Azure AI Foundry | Microsoft Learn

- VS Code: Open Source AI Editor

- Azure AI Foundry – centrum rozwoju generatywnej sztucznej inteligencji