AI Toolkit for Visual Studio Code

W dobie dynamicznego rozwoju sztucznej inteligencji, programiści potrzebują coraz bardziej zaawansowanych narzędzi wspierających tworzenie aplikacji AI. Microsoft odpowiada na te potrzeby wprowadzając AI Toolkit for Visual Studio Code.

Czym jest AI Toolkit?

AI Toolkit for Visual Studio Code to kompleksowe rozszerzenie zaprojektowane z myślą o programistach i inżynierach AI, którzy chcą efektywnie tworzyć aplikacje wykorzystujące sztuczną inteligencję. Narzędzie umożliwia łatwe budowanie aplikacji i agentów AI poprzez rozwój i testowanie modeli generatywnych zarówno lokalnie, jak i w chmurze. Warto podkreślić, że rozszerzenie wspiera większość popularnych modeli genAI dostępnych obecnie na rynku, co daje programistom niespotykaną dotąd elastyczność.

Rozszerzenie to stanowi część ekosystemu narzędzi Microsoft dla deweloperów AI, uzupełniając wprowadzone wcześniej Windows AI Studio – platformę ułatwiającą lokalny rozwój i wdrażanie AI w systemie Windows. Dzięki prostemu interfejsowi użytkownika, programiści mogą z łatwością odkrywać i testować popularne modele AI bez konieczności zagłębiania się w skomplikowane konfiguracje.

Kluczowe funkcjonalności

AI Toolkit oferuje szereg zaawansowanych funkcji, które przyspieszają proces tworzenia rozwiązań opartych na sztucznej inteligencji. Rozszerzenie pozwala na pobieranie, testowanie, dostrajanie i wdrażanie modeli AI bezpośrednio z poziomu edytora VS Code. Do najważniejszych możliwości należą:

- Interaktywny playground wspierający załączniki, wyszukiwanie w sieci i tryb myślenia, co umożliwia bardziej interaktywne eksperymentowanie z modelami

- Możliwość uruchamiania wielu promptów w trybie wsadowym, co zwiększa efektywność testowania

- Ewaluacja promptów w zestawie danych przy użyciu popularnych ewaluatorów

- Dostrajanie (fine-tuning) i wdrażanie modeli AI bezpośrednio z interfejsu VS Code.

Praktyczne zastosowania

AI Toolkit znacząco upraszcza pracę programistów AI poprzez integrację całego cyklu rozwoju w jednym środowisku. W praktyce oznacza to, że deweloperzy mogą skupić się na tworzeniu wartościowych rozwiązań AI zamiast tracić czas na konfigurację i integrację różnych narzędzi. Rozszerzenie szczególnie dobrze sprawdza się w scenariuszach:

- Tworzenia aplikacji wykorzystujących małe modele językowe (SLM) działające lokalnie

- Testowania i porównywania różnych modeli AI pod kątem konkretnych zastosowań

- Wdrażania hybrydowych rozwiązań AI wykorzystujących moc obliczeniową zarówno lokalną, jak i chmurową.

Jak zainstalować?

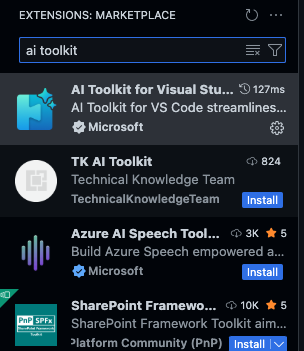

By zainstalować i przetestować modele należy zakładce Extensions wyszukać AI Toolkit for Visual Studio Code.

Jakie modele są dostępne?

W wtyczce są do wyboru modele uruchamiane lokalnie przez ollamę oraz ONNX, ale też hostowane przez GitHub jak i te hostowane przez Anthropic, OpenAI i Google.

| Źródło/model | Przykładowe modele | Typ modelu | Tryb działania | Wymagania/licencja |

|---|---|---|---|---|

| GitHub-hosted | Llama3, Phi-3, Mistral | SLM, LLM | Lokalnie/chmura | Konto GitHub, open source |

| OpenAI | ChatGPT (GPT-3.5, GPT-4) | LLM | Chmura | Klucz API OpenAI |

| Anthropic | Claude (Claude 2, Claude 3) | LLM | Chmura | Klucz API Anthropic |

| Gemini | LLM | Chmura | Klucz API Google | |

| Microsoft | Phi-3, Phi-3.5 | SLM | Lokalnie/chmura | Zależnie od modelu |

| Meta | Llama (Llama2, Llama3) | LLM | Lokalnie/chmura | Zależnie od modelu |

| Mistral AI | Mistral, Mixtral | SLM, LLM | Lokalnie/chmura | Zależnie od modelu |

| Hugging Face | Dowolne modele z katalogu HF | SLM, LLM | Lokalnie/chmura | Konto HF, open source |

| Ollama | Llama2, Llama3, Mistral, Phi-3 | SLM, LLM | Lokalnie (CPU/GPU/NPU) | Zainstalowany Ollama |

| Bring Your Own Model | DeepSeek R1, inne własne modele | SLM, LLM | Lokalnie/chmura | Własna konfiguracja |