DeepSeek-Math-V2 to wyspecjalizowany, otwartoźródłowy model językowy zaprojektowany do rozwiązywania zadań matematycznych na poziomie olimpijskim oraz generowania formalnych dowodów. W odróżnieniu od typowych LLM-ów koncentruje się nie tylko na poprawności odpowiedzi, ale także na poprawności całego łańcucha rozumowania, wykorzystując mechanizmy samoweryfikacji.

Architektura i główne założenia techniczne

DeepSeek-Math-V2 bazuje na rodzinie modeli DeepSeek-V3.2 i wykorzystuje architekturę transformera dostosowaną do bardzo długich kontekstów, co pozwala obsługiwać wielostronicowe ciągi dowodów. Model ma setki miliardów aktywowanych parametrów (685B w konfiguracji pełnej), z obsługą różnych typów tensorów (BF16, F8, F32), co umożliwia kompromis między precyzją a kosztami obliczeń.

Kluczowym elementem jest podział na komponent generujący (generator dowodów) oraz komponent weryfikujący (weryfikator), które współpracują podczas uczenia i wnioskowania. Podejście to ma rozwiązać problem, w którym wysoka trafność końcowej odpowiedzi nie gwarantuje poprawnego rozumowania krok po kroku, co jest krytyczne w formalnym dowodzeniu twierdzeń.

| Cechа | Typowy LLM ogólnego przeznaczenia | DeepSeek-Math-V2 |

|---|---|---|

| Cel uczenia | Maksymalizacja trafności końcowej odpowiedzi | Maksymalizacja poprawności całego dowodu i odpowiedzi |

| Architektura | Pojedynczy model generatywny | Generator + weryfikator + metaweryfikator |

| Długość kontekstu | Najczęściej dziesiątki–setki kroków | Wydłużone sekwencje dla pełnych dowodów |

| Licencja | Różne, często zamknięte | Apache 2.0 – otwarte wagi |

| Typowe zastosowania | Chat, kod, ogólne QA | Zadania olimpijskie, dowody, weryfikacja formalna |

Samoweryfikacja i proces wnioskowania

DeepSeek-Math-V2 stosuje schemat „verifier–generator”, w którym model generuje kandydackie dowody, a następnie weryfikator ocenia każdy krok pod kątem zgodności z regułami matematycznymi. W procesie wnioskowania wykorzystywane są iteracyjne cykle udoskonalania: spośród wielu dowodów wybierane są te o najwyższej ocenie weryfikatora, analizowane, łączone i ponownie generowane, aż do uzyskania wersji o wysokim poziomie pewności.

W części konfiguracji do eksploracji przestrzeni dowodów wykorzystywane są techniki zbliżone do Monte Carlo Tree Search, które umożliwiają przeszukiwanie alternatywnych gałęzi rozumowania i odrzucanie tych, które nie przechodzą testów weryfikatora. Samoweryfikacja jest traktowana jako dodatkowy „test-time compute”, czyli zwiększenie nakładu obliczeń na etapie wnioskowania zamiast wyłącznie w fazie treningu.

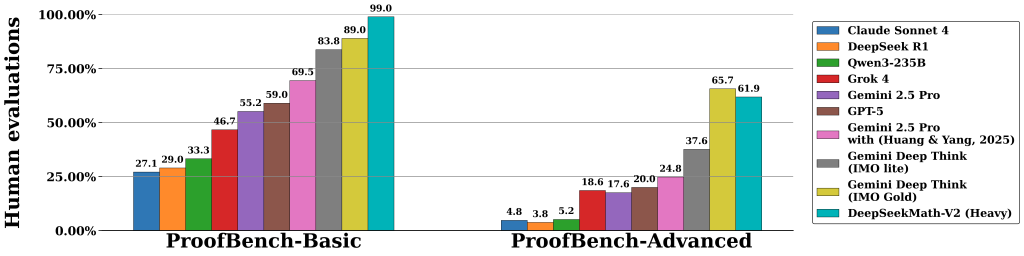

Wyniki na benchmarkach i konkursach

Model osiągnął wyniki na poziomie złotego medalu w Międzynarodowej Olimpiadzie Matematycznej 2025 (IMO 2025) oraz w chińskiej olimpiadzie CMO 2024, co oznacza rozwiązanie zadań porównywalnych z najlepszymi uczestnikami ludzkimi. DeepSeek-Math-V2 uzyskał także wynik 118/120 na zestawie zadań inspirowanych konkursem Putnam 2024, jednym z najtrudniejszych konkursów matematycznych na poziomie uniwersyteckim.

W praktyce oznacza to, że model potrafi nie tylko udzielać odpowiedzi, ale również tworzyć szczegółowe, wieloetapowe dowody dla problemów z algebry, geometrii, teorii liczb czy kombinatoryki. Dla społeczności open source istotne jest, że taka wydajność została osiągnięta przy jednoczesnym udostępnieniu wag i kodu, co umożliwia niezależną replikację wyników i dalsze badania.

Praktyczne zastosowania i integracja

DeepSeek-Math-V2 można pobrać jako otwarty model z platform takich jak Hugging Face, z gotowymi skryptami do inferencji i przykładami użycia dla zadań typu „solve-and-prove”. Dzięki licencji Apache 2.0 model nadaje się do zastosowań badawczych i komercyjnych, o ile użytkownik przestrzega warunków licencji i zasad odpowiedzialnego wykorzystania.

- W edukacji może pełnić rolę asystenta rozwiązującego zadania krok po kroku, z naciskiem na poprawną argumentację, a nie tylko wynik.

- W badaniach nad weryfikacją formalną może wspierać generowanie szkiców dowodów, które następnie są doprecyzowywane w narzędziach typu proof assistant.

- W inżynierii oprogramowania matematycznego i kryptografii może pomagać w analizie poprawności własności systemów oraz w wykrywaniu błędów w rozumowaniach numerycznych.

Dla zespołów inżynierskich istotne jest przygotowanie odpowiedniej infrastruktury – model wymaga wielogpuowych środowisk lub wyspecjalizowanego sprzętu, a w zastosowaniach produkcyjnych często stosuje się kwantyzację i techniki oszczędzania pamięci. Mimo wysokich kosztów obliczeniowych, w zastosowaniach, gdzie kluczowa jest poprawność formalna (np. dowody, weryfikacja, konkursy), taki kompromis jest akceptowalny.

Źródła

- deepseek-ai/DeepSeek-Math-V2 (GitHub)

- DeepSeek-Math-V2 (Hugging Face)

- How Does DeepSeekMath-V2 Achieve Self-Verifying Mathematical Reasoning? (dev.to)

- DeepSeekMath-V2 Advances Self-Verifiable Mathematical Reasoning (APIDog)

- DeepSeek Unveils Math-V2 for High-Precision Math Reasoning (Times of AI)

- DeepSeek-Math-V2 analysis (Simon Willison)