LM Studio to desktopowe narzędzie umożliwiające uruchamianie, testowanie i zarządzanie otwartymi modelami językowymi (LLM) bezpośrednio na własnym sprzęcie. Aplikacja działa w pełni offline, co gwarantuje prywatność danych i eliminuje konieczność korzystania z chmurowych API, dając użytkownikom pełną kontrolę nad procesem.

Kluczowe aspekty techniczne

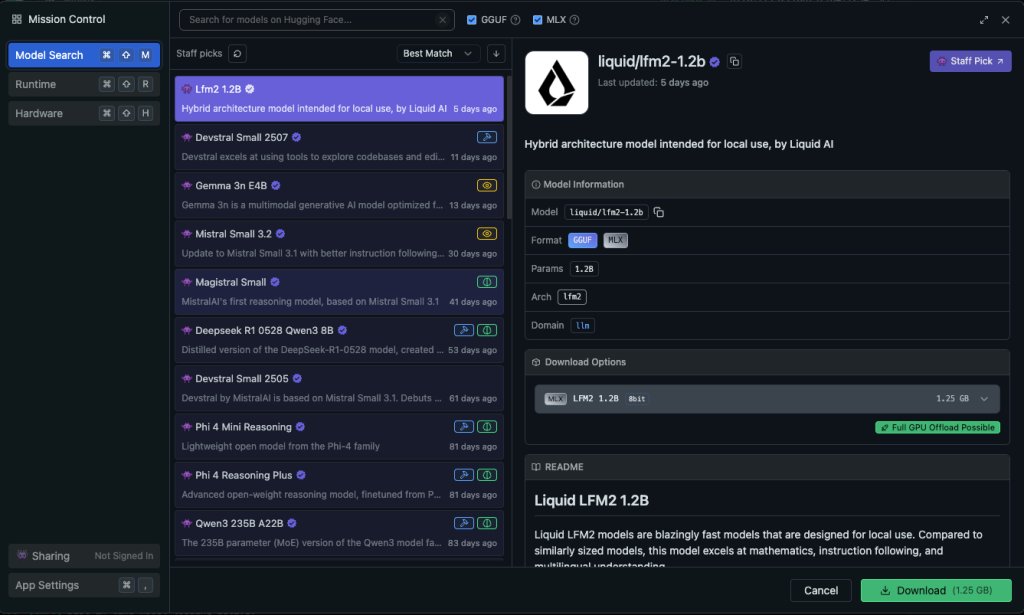

Podstawową funkcją LM Studio jest uproszczenie interakcji z modelami LLM. Aplikacja oferuje graficzny interfejs użytkownika (GUI), za pomocą którego można wyszukiwać i pobierać modele z repozytorium Hugging Face, głównie w formacie GGUF. Eliminuje to potrzebę pracy z wierszem poleceń i ręcznej konfiguracji środowiska, co czyni technologię bardziej dostępną. Narzędzie pozwala także na uruchomienie lokalnego serwera, który udostępnia API zgodne ze standardem OpenAI. Dzięki temu deweloperzy mogą integrować lokalnie działające modele z własnymi aplikacjami lub narzędziami deweloperskimi.

Aby ułatwić integrację, LM Studio dostarcza oficjalne pakiety SDK dla języków Python i JavaScript (TypeScript). Poniższa tabela przedstawia podstawowe dane techniczne platformy.

| Cecha | Specyfikacja |

|---|---|

| Wspierane platformy | Windows, macOS (Apple Silicon), Linux |

| Formaty modeli | GGUF (wszystkie platformy), MLX (tylko macOS) |

| Główne integracje | Repozytorium Hugging Face, API zgodne z OpenAI |

| Narzędzia deweloperskie | SDK dla Python i JavaScript/TypeScript |

Instalacja

Instalacja jest bardzo prosta, wystarczy pobrać instalator stąd i przejść przez instalator.

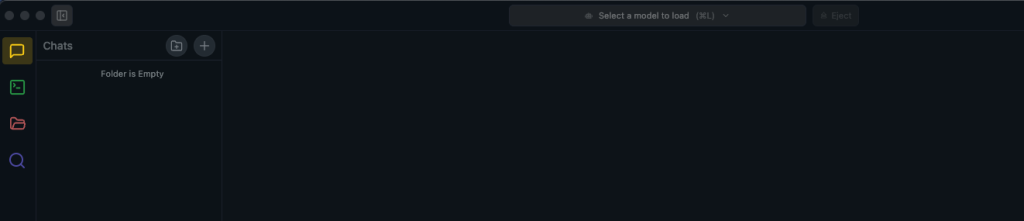

Po instalacji i uruchomieniu interfejs jest dość prosty i są następujące elementy:

- Chat – Rozmowy z modelami

- Developer – znajdziesz takie elementy jak uruchomienie serwera z modelem.

- My models – pobrane modele i zarządzanie nimi.

- Discover – Wyszukiwarka modeli.

Praktyczne zastosowania

LM Studio znajduje zastosowanie w różnych scenariuszach, gdzie kluczowa jest prywatność, kontrola kosztów i możliwość pracy w trybie offline. Narzędzie jest idealne do prototypowania i testowania aplikacji opartych na AI, ponieważ pozwala deweloperom na swobodne eksperymentowanie z różnymi modelami bez ponoszenia opłat za zużycie API.

- Edukacja i badania: Umożliwia studentom i badaczom naukę działania modeli LLM w bezpiecznym, odizolowanym środowisku.

- Praca z danymi wrażliwymi: Firmy z sektorów takich jak finanse, prawo czy zdrowie mogą wykorzystywać LLM do analizy poufnych informacji bez ryzyka ich wycieku do zewnętrznych usług.

- Rozwój aplikacji offline: Pozwala na tworzenie narzędzi desktopowych, które wykorzystują AI bez konieczności stałego połączenia z internetem.

- Prywatna analiza dokumentów: Funkcja RAG (Retrieval-Augmented Generation) umożliwia prowadzenie konwersacji z lokalnymi plikami (np. PDF, TXT) z zachowaniem pełnej poufności danych.