Ocena modeli językowych to jedno z najtrudniejszych wyzwań współczesnej inżynierii AI. Liczba parametrów czy rozmiar zbioru treningowego niewiele mówią o tym, czy model poradzi sobie z prawdziwym zadaniem. Dlatego środowisko badawcze wypracowało szereg wystandaryzowanych benchmarków — zestawów testów pozwalających porównywać modele na wspólnej skali. Poniżej przegląd najważniejszych z nich, pogrupowanych według mierzonych kompetencji.

Wiedza ogólna i rozumowanie

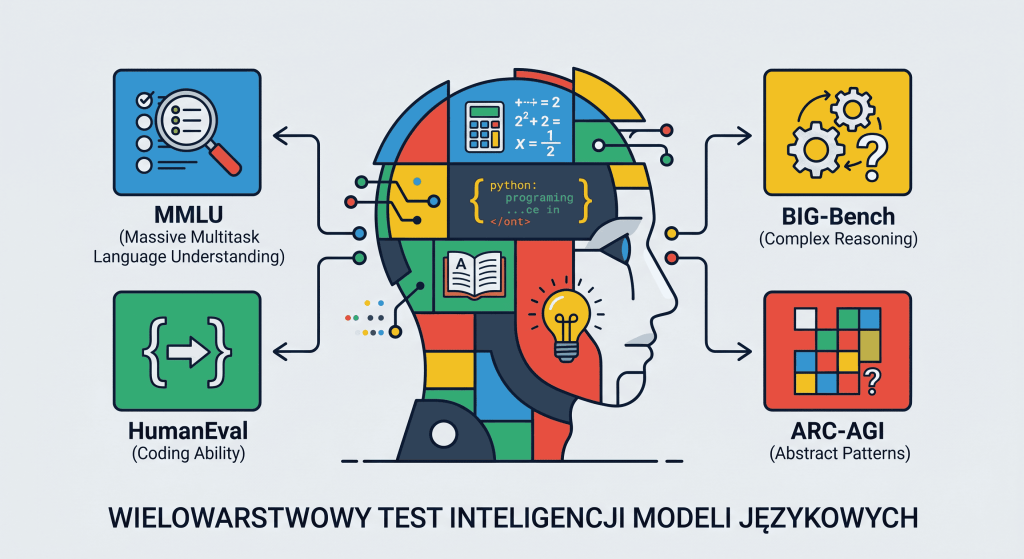

MMLU (Massive Multitask Language Understanding) to obecnie de facto standard w ocenie “wiedzy encyklopedycznej” modeli. Składa się z pytań wielokrotnego wyboru z 57 dziedzin — od matematyki, prawa i historii po medycynę i etykę. Wysoki wynik w MMLU sygnalizuje, że model przyswoił rozległą wiedzę faktograficzną, choć krytycy wskazują, że dobry wynik można osiągnąć przez zapamiętywanie wzorców, nie przez rozumowanie.

Odpowiedzią na tę słabość jest MMLU-Pro — zrewidowana wersja benchmarku, która zastępuje proste pytania o fakty zadaniami wymagającymi wieloetapowego wnioskowania. Zamiast rozpoznać poprawną odpowiedź, model musi przez nią przejść logicznie. To sprawia, że MMLU-Pro jest znacznie odporniejszy na “kucie” i lepiej różnicuje modele na górze rankingu.

BIG-Bench idzie jeszcze dalej — to zbiór ponad 200 zadań zaprojektowanych tak, żeby wykraczały poza standardowe wzorce treningowe. Zadania obejmują analogie, zagadki logiczne, rozumowanie kontrfaktyczne i wiele innych kompetencji, których nie da się nauczyć przez mechaniczne zapamiętywanie. BIG-Bench był przez długi czas “ścianą”, przy której nawet duże modele wypadały słabo.

Osobną kategorią jest ARC-AGI (Abstraction and Reasoning Corpus for Artificial General Intelligence). Benchmark składa się z zagadek graficznych opartych na prostych regułach wizualnych — trywialne dla przeciętnego człowieka, ale ekstremalnie trudne dla modeli językowych. ARC-AGI mierzy coś, czego inne testy nie chwytają dobrze: zdolność do indukcji reguł z nielicznych przykładów, bez wcześniejszego “widzenia” danego wzorca. Modele, które świetnie radzą sobie z MMLU, często zupełnie zawodzą tutaj.

Matematyka i logika

MATH to zbiór kilku tysięcy zadań matematycznych na poziomie olimpijskim i akademickim — algebra, geometria, rachunek różniczkowy, teoria liczb i kombinatoryka. Kluczową cechą benchmarku jest to, że ocenia nie tylko poprawność końcowego wyniku, ale również tok rozumowania. Dzięki temu MATH ujawnia, czy model naprawdę “rozumie” matematykę, czy tylko zgaduje odpowiedź końcową.

GSM8K to bardziej przystępna propozycja — szkolne zadania tekstowe z matematyki, które wymagają kilku kroków arytmetycznych. Popularność benchmarku wynika głównie z tego, że doskonale nadaje się do testowania techniki Chain-of-Thought (łańcuch myślenia), w której model zapisuje pośrednie kroki rozumowania przed podaniem odpowiedzi. GSM8K stał się standardowym testem przy wprowadzaniu i porównywaniu technik promptowania.

Umiejętności programowania

HumanEval to benchmark opracowany przez OpenAI, w którym model generuje kod Pythona realizujący opisaną funkcję. Ocena odbywa się automatycznie — napisany kod uruchamiany jest na zestawie testów jednostkowych, a wynik wyrażany jest metryką Pass@k (prawdopodobieństwo, że przynajmniej jedno z k wygenerowanych rozwiązań przejdzie wszystkie testy). To podejście jest obiektywne i powtarzalne, choć zadania w HumanEval są stosunkowo izolowane i rzadko odzwierciedlają prawdziwe wyzwania inżynierskie.

Znacznie bliżej realiów jest SWE-bench. Tutaj model dostaje autentyczne zgłoszenie błędu z GitHuba wraz z kodem repozytorium i ma za zadanie napisać łatkę, która rzeczywiście naprawia problem. Ocena odbywa się przez uruchomienie testów regresyjnych oryginalnego projektu. SWE-bench jest wyraźnie trudniejszy niż HumanEval i znacznie lepiej symuluje codzienną pracę programisty — wymaga rozumienia większych baz kodu, lokalizacji błędu i napisania poprawki, która nie psuje istniejących funkcjonalności.

Zdrowy rozsądek i jakość językowa

HellaSwag sprawdza, czy model potrafi wskazać logiczne zakończenie zdania opisującego codzienną sytuację. Choć brzmi prosto, benchmark był przez długi czas trudny dla modeli — wymaga rozumienia kontekstu i realiów świata, nie tylko gramatyki. Dobry wynik w HellaSwag sugeruje, że model ma solidną intuicję językową i rozumie ludzkie działania w typowych scenariuszach.

TruthfulQA testuje zupełnie inną właściwość: skłonność modelu do halucynacji. Pytania są celowo skonstruowane tak, żeby “kusić” model do popularnych, ale błędnych odpowiedzi — na przykład mity, miejskie legendy czy powszechne nieporozumienia. Model, który po prostu odtwarza częste wzorce z internetu, wypada tu słabo. TruthfulQA jest szczególnie istotny przy ocenie modeli przeznaczonych do zastosowań wymagających rzetelności informacji.

Ocena jakości konwersacji

Benchmarki statyczne mają jedną zasadniczą wadę — mierzą modele na pytaniach, które mogły trafić do zbiorów treningowych. Dlatego coraz więcej uwagi przyciągają metody oceny oparte na prawdziwych interakcjach użytkowników.

LMSYS Chatbot Arena to platforma, na której użytkownicy rozmawiają jednocześnie z dwoma anonimowymi modelami i głosują na lepszą odpowiedź. Wyniki agregowane są w ranking Elo — ten sam system stosowany w szachach. Ponieważ ranking oparty jest na milionach prawdziwych rozmów, a nie syntetycznych testach, odzwierciedla preferencje użytkowników znacznie lepiej niż większość benchmarków akademickich. Wadą jest brak kontroli nad typem pytań i trudność w interpretacji, co dokładnie jest mierzone.

MT-Bench to podejście pośrednie — zestaw wieloturowych rozmów ocenianych automatycznie przez silniejszy model LLM pełniący rolę sędziego. Testuje spójność odpowiedzi w dłuższym dialogu, zdolność do podążania za kontekstem i jakość merytoryczną. Użycie LLM jako sędziego jest kontrowersyjne (model może faworyzować odpowiedzi podobne do własnych), ale pozwala na szybką i skalowalną ocenę bez udziału ludzi.

Polski kontekst: Open PL LLM Leaderboard

Zdecydowana większość benchmarków jest anglojęzyczna, co sprawia, że wyniki słabo przekładają się na ocenę modeli używanych w języku polskim. Inicjatywa Open PL LLM Leaderboard prowadzona przez SpeakLeash wypełnia tę lukę — to jedyny poważny ranking oceniający modele językowe na polskojęzycznych zadaniach. Obejmuje zadania z rozumienia tekstu, wnioskowania, wiedzy ogólnej i generowania odpowiedzi po polsku. Dla firm i badaczy pracujących z polskim NLP jest to znacznie bardziej miarodajne narzędzie niż próba interpretowania wyników z anglojęzycznych benchmarków.

Jak czytać benchmarki: kilka ważnych zastrzeżeń

Wyniki benchmarków warto traktować jako wskazówki, nie wyroki. Kilka kwestii, o których warto pamiętać przy ich interpretacji:

- Wiele zbiorów testowych jest publicznie dostępnych, więc istnieje ryzyko, że dane treningowe modelu zawierają pytania z benchmarku — zjawisko znane jako data contamination.

- Wysoki wynik w jednym benchmarku nie gwarantuje dobrej wydajności w innym — modele często są wyspecjalizowane.

- Benchmarki akademickie nie zawsze korelują z użytecznością w praktycznych zastosowaniach.

- Sposób promptowania (zero-shot, few-shot, chain-of-thought) potrafi znacząco zmienić wynik bez zmiany samego modelu.

- Rankingi starzeją się szybko — w 2025 roku modele regularnie osiągały wyniki bliskie saturacji na benchmarkach, które rok wcześniej były uważane za trudne.

Dlatego profesjonalna ocena modelu powinna łączyć wyniki z kilku benchmarków różnego typu — akademickich, opartych na prawdziwych zadaniach i, jeśli to możliwe, ocenianych przez użytkowników końcowych w docelowym języku i domenie.

Źródła

- MMLU: Measuring Massive Multitask Language Understanding (Hendrycks et al., 2020)

- MMLU-Pro: A More Robust and Challenging Multi-Task Language Understanding Benchmark

- BIG-Bench: Beyond the Imitation Game Benchmark (GitHub)

- ARC-AGI Prize – oficjalna strona benchmarku

- MATH Dataset (Hendrycks et al., 2021)

- GSM8K: Training Verifiers to Solve Math Word Problems

- HumanEval (OpenAI, GitHub)

- SWE-bench – oficjalna strona

- HellaSwag: Can a Machine Really Finish Your Sentence?

- TruthfulQA (GitHub)

- LMSYS Chatbot Arena

- MT-Bench and Chatbot Arena: Judging LLM-as-a-Judge

- Open PL LLM Leaderboard (SpeakLeash, Hugging Face)