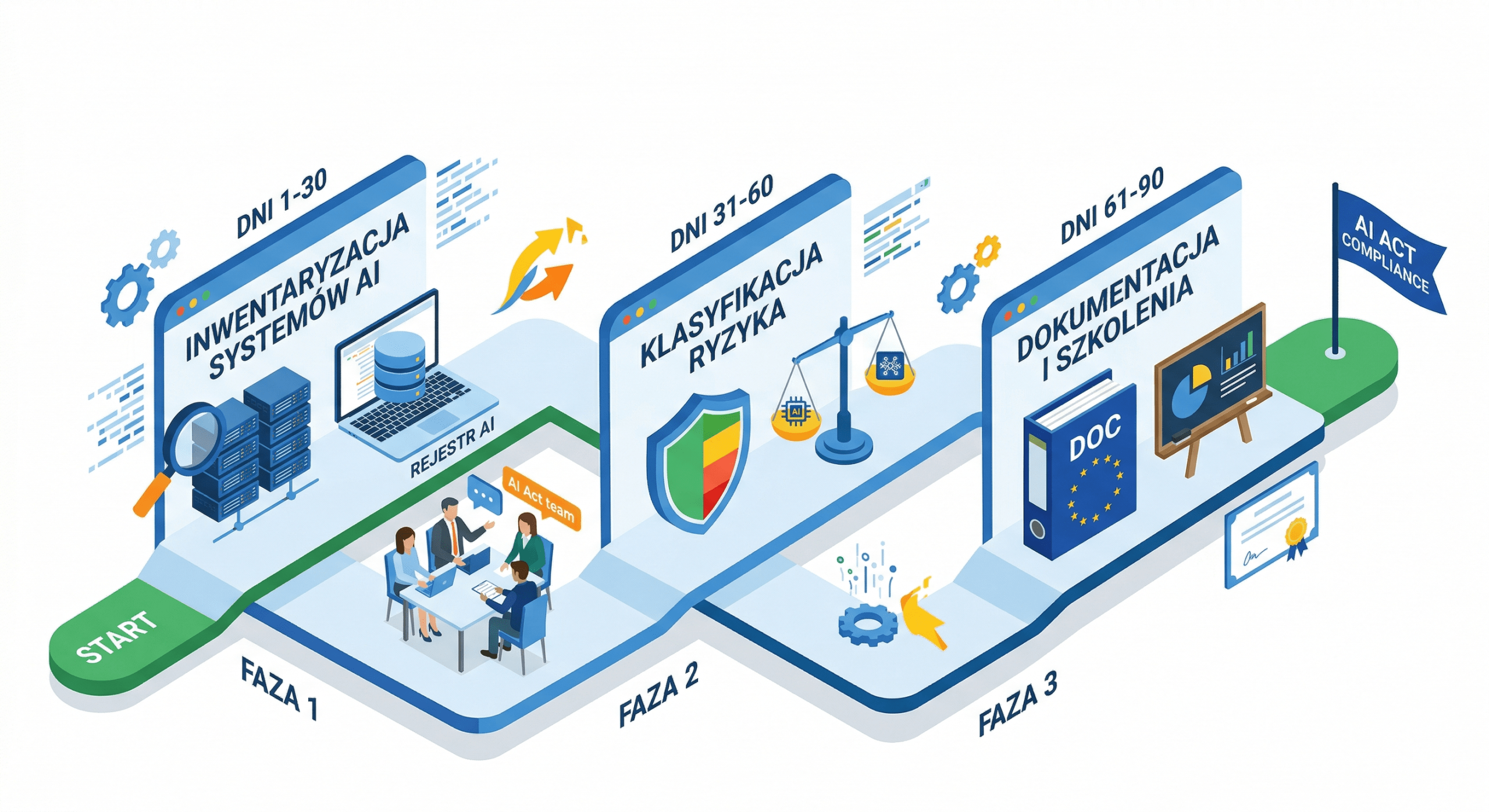

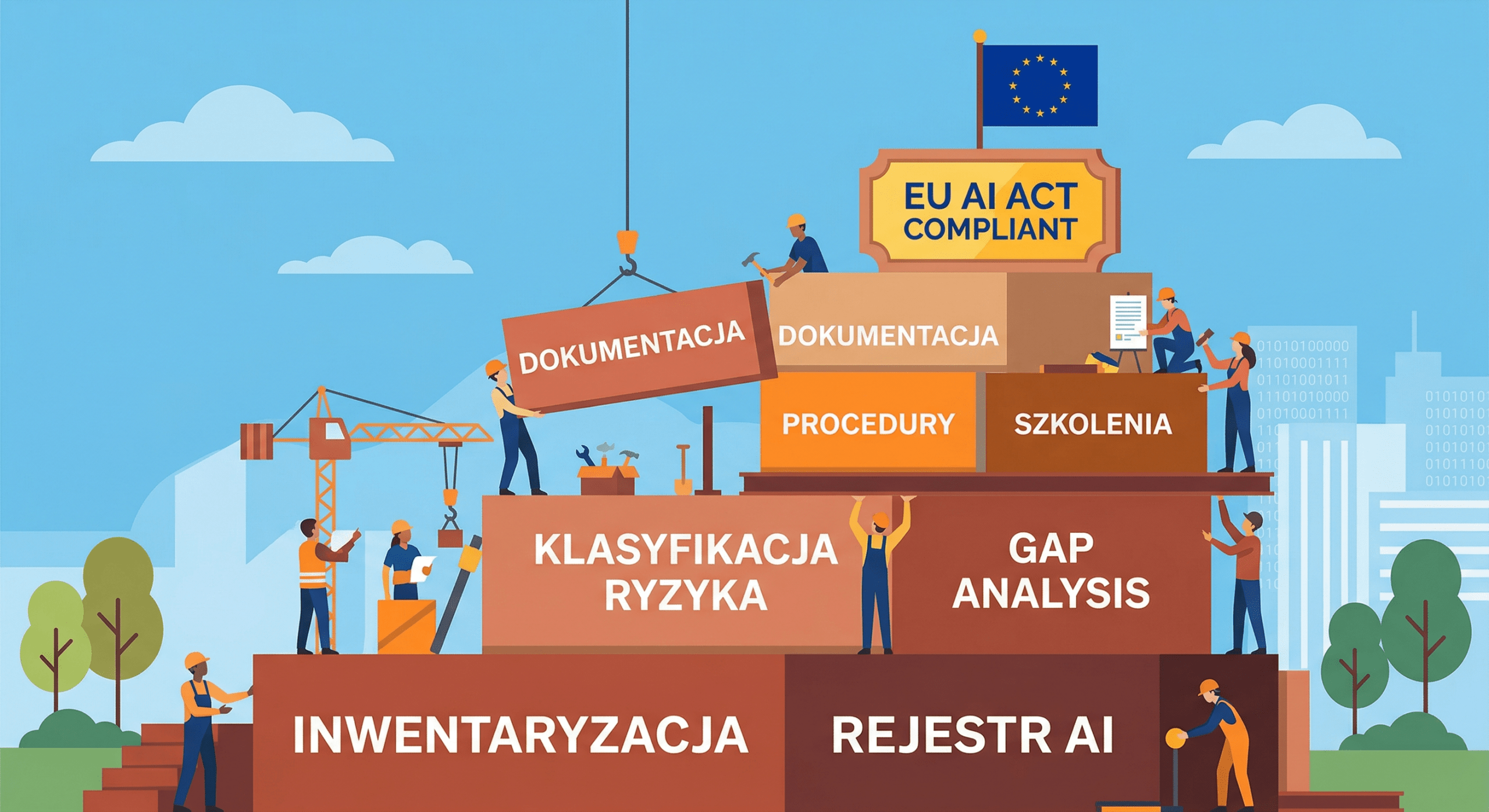

Unijne rozporządzenie w sprawie sztucznej inteligencji (AI Act) weszło w życie w sierpniu 2024 roku, a jego kluczowe przepisy dotyczące systemów wysokiego ryzyka zaczęły obowiązywać stopniowo – część wymagań jest już aktywna, inne wejdą w życie do sierpnia 2026 roku. Dla firm, które dopiero zaczynają swoją drogę do zgodności, 90-dniowy plan działania to realistyczny horyzont na przeprowadzenie inwentaryzacji, klasyfikacji i wdrożenia podstawowych procedur. Poniższy checklist jest narzędziem roboczym – nie poradą prawną – który pomaga ustrukturyzować ten proces.

Faza 1 (Dni 1–30): Inwentaryzacja systemów AI

Zanim cokolwiek sklasyfikujesz lub udokumetujesz, musisz wiedzieć, co w ogóle działa w Twojej organizacji. Wiele firm korzysta z systemów opartych na AI bez formalnej ewidencji – narzędzia do rekrutacji, chatboty obsługi klienta, systemy scoringowe czy modele predykcyjne wbudowane w oprogramowanie zewnętrznych dostawców. Faza pierwsza ma jeden cel: stworzyć kompletny rejestr.

- Powołaj wewnętrzny zespół ds. AI Act – minimum: osoba z IT, prawnik lub compliance officer, przedstawiciel biznesu. Wyznacz koordynatora odpowiedzialnego za cały projekt.

- Zdefiniuj zakres inwentaryzacji – określ, które działy, systemy i procesy wchodzą w zakres. Uwzględnij systemy wewnętrzne, SaaS i rozwiązania dostarczone przez zewnętrznych vendorów.

- Przeprowadź ankietę we wszystkich działach – poproś kierowników o wskazanie wszelkich narzędzi, które automatycznie podejmują lub wspierają decyzje dotyczące ludzi lub procesów biznesowych.

- Przejrzyj umowy z dostawcami oprogramowania – zidentyfikuj, które zakupione systemy zawierają komponenty AI. Sprawdź dokumentację techniczną i karty produktu.

- Utwórz rejestr systemów AI – dla każdego systemu zapisz: nazwę, dostawcę, cel użycia, dane wejściowe i wyjściowe, obszar biznesowy, osobę odpowiedzialną oraz status (produkcja / testowanie / wycofany).

- Zidentyfikuj systemy rozwijane wewnętrznie – modele ML, skrypty automatyzujące decyzje kadrowe, narzędzia analityczne budowane przez własny dział IT. Te systemy wymagają szczególnej uwagi, bo Twoja firma jest ich dostawcą i operatorem jednocześnie.

- Określ rolę organizacji wobec każdego systemu – AI Act rozróżnia dostawców (providers), operatorów (deployers), importerów i dystrybutorów. Każda rola niesie inne obowiązki.

- Udokumentuj infrastrukturę danych – dla każdego systemu AI wskaż, jakie dane są używane do trenowania lub działania modelu, skąd pochodzą i jak długo są przechowywane.

- Zweryfikuj systemy u zewnętrznych dostawców chmury – np. Microsoft Azure AI, Google Vertex AI, AWS SageMaker. Zapytaj dostawcę o ich własne działania zgodności z AI Act.

- Zamknij rejestr i przeprowadź przegląd wewnętrzny – do końca 30. dnia powinieneś mieć pełną listę systemów z wypełnionymi metadanymi.

Faza 2 (Dni 31–60): Klasyfikacja ryzyka i analiza luk

AI Act dzieli systemy AI na cztery kategorie: systemy zakazane, wysokiego ryzyka, ograniczonego ryzyka i minimalnego ryzyka. Klasyfikacja nie jest zawsze oczywista i wymaga połączenia wiedzy technicznej z prawną. Równolegle z klasyfikacją warto przeprowadzić analizę luk (gap analysis), czyli porównanie aktualnego stanu z tym, czego wymaga rozporządzenie.

- Zapoznaj się z Załącznikiem III AI Act – lista systemów wysokiego ryzyka obejmuje m.in. systemy zarządzania infrastrukturą krytyczną, systemy rekrutacyjne, systemy oceny zdolności kredytowej, systemy wspomagające wymiar sprawiedliwości oraz systemy biometryczne.

- Sklasyfikuj każdy system z rejestru – przypisz kategorię ryzyka: zakazany / wysokiego ryzyka / ograniczonego ryzyka / minimalnego ryzyka. Zachowaj uzasadnienie klasyfikacji w dokumentacji.

- Zidentyfikuj systemy zakazane – AI Act zakazuje m.in. systemów social scoringu przez władze publiczne, manipulacji podprogowej oraz – z pewnymi wyjątkami – masowej biometrycznej identyfikacji w czasie rzeczywistym w przestrzeni publicznej. Jeśli którykolwiek system z rejestru wpisuje się w te kategorie, natychmiast eskaluj do zarządu i prawników.

- Przeprowadź gap analysis dla systemów wysokiego ryzyka – sprawdź, czy istnieje: system zarządzania ryzykiem, dokumentacja techniczna (technical documentation), mechanizm logowania i audytowalności, nadzór ludzki (human oversight), mechanizmy dokładności i odporności.

- Oceń, czy systemy wymaga rejestracji w bazie EU – systemy wysokiego ryzyka muszą być wpisane do unijnej bazy danych systemów AI (EUDAMED-equivalent dla AI), prowadzonej przez Komisję Europejską.

- Sprawdź zgodność z przepisami o przejrzystości – systemy ograniczonego ryzyka (np. chatboty, deepfake) muszą informować użytkowników, że rozmawiają z AI lub że treść jest generowana automatycznie.

- Zidentyfikuj luki w zakresie danych treningowych – systemy wysokiego ryzyka wymagają udokumentowania zbiorów danych: źródła, reprezentatywność, potencjalne uprzedzenia (bias).

- Przeanalizuj umowy z dostawcami zewnętrznych systemów AI – sprawdź, czy dostawca dostarcza wymaganą przez AI Act dokumentację techniczną. Jeśli nie, skontaktuj się z dostawcą w celu uzyskania tych materiałów lub aktualizacji umowy.

- Utwórz macierz priorytetów – posegreguj systemy według poziomu ryzyka i pilności działań naprawczych. Skup zasoby najpierw tam, gdzie ryzyko jest najwyższe.

- Przygotuj raport z gap analysis – dokument podsumowujący stan zgodności każdego systemu, zidentyfikowane luki i rekomendowane działania. To wejście do Fazy 3.

Faza 3 (Dni 61–90): Dokumentacja, procedury i szkolenia

Trzecia faza to zamiana wyników analizy w konkretne działania operacyjne. To tutaj powstają dokumenty wymagane przez AI Act, wdrażane są procedury zarządzania ryzykiem i przeprowadzane szkolenia dla pracowników. W przypadku dużych organizacji 30 dni może być za mało na pełne wdrożenie – celem tej fazy jest stworzenie solidnych fundamentów i planu na dalsze prace.

- Opracuj dokumentację techniczną dla każdego systemu wysokiego ryzyka – AI Act (Artykuł 11 i Załącznik IV) precyzuje zawartość: ogólny opis systemu, architektura, dane treningowe, wyniki testów, opis nadzoru ludzkiego, środki cyberbezpieczeństwa.

- Wdroż system zarządzania ryzykiem AI – zgodnie z Art. 9, system zarządzania ryzykiem musi być ciągłym procesem, obejmującym identyfikację, ocenę i mitygację ryzyk przez cały cykl życia systemu.

- Skonfiguruj mechanizmy logowania zdarzeń – systemy wysokiego ryzyka muszą automatycznie rejestrować kluczowe zdarzenia operacyjne. Sprawdź, czy Twoje systemy mają tę funkcję i czy logi są przechowywane przez wymagany czas.

- Opracuj instrukcje dla operatorów (instructions for use) – dokument opisujący, jak bezpiecznie i zgodnie z przeznaczeniem korzystać z systemu AI, jakie są jego ograniczenia i kiedy wymagany jest nadzór ludzki.

- Wprowadź procedurę oceny zgodności – dla systemów wysokiego ryzyka z Załącznika III (poza sektorem regulowanym, jak pojazdy autonomiczne czy wyroby medyczne) ocena zgodności może być przeprowadzona samodzielnie (self-assessment). Udokumentuj ten proces.

- Przygotuj deklarację zgodności UE – wymagana dla systemów wysokiego ryzyka. Dostawca podpisuje deklarację, że system spełnia wymagania AI Act.

- Wdroż procedurę zarządzania incydentami – Art. 73 wymaga zgłaszania poważnych incydentów związanych z systemami wysokiego ryzyka do właściwych organów nadzorczych. Określ, co jest incydentem, kto go zgłasza i w jakim terminie.

- Opracuj politykę zarządzania systemami AI – wewnętrzny dokument opisujący zasady wdrażania, monitorowania i wycofywania systemów AI w organizacji, zgodny z wymogami AI Act.

- Przeprowadź szkolenia dla pracowników korzystających z systemów AI – Art. 4 AI Act wprowadza obowiązek zapewnienia „AI literacy” pracownikom. Szkolenie powinno obejmować: podstawy działania AI, ryzyka i ograniczenia konkretnych narzędzi, zasady nadzoru i eskalacji.

- Przeszkol zespół odpowiedzialny za zgodność – głębsze szkolenie dla compliance officerów, prawników i menedżerów IT z zakresu szczegółowych wymagań AI Act.

- Zarejestruj systemy wysokiego ryzyka w unijnej bazie danych – jeśli jesteś dostawcą lub operatorem systemu wysokiego ryzyka, sprawdź aktualny status i terminy rejestracji.

- Zaplanuj cykliczne przeglądy zgodności – AI Act wymaga ciągłego monitorowania. Ustal harmonogram kwartalnych przeglądów rejestru systemów AI, aktualizacji dokumentacji i oceny nowych wdrożeń.

- Udokumentuj cały proces i zachowaj dowody – organy nadzorcze mogą żądać dostępu do dokumentacji. Przechowuj raporty, protokoły ze spotkań i wersje dokumentów w ustrukturyzowany sposób.

Co po 90 dniach?

Po zakończeniu trzech faz Twoja organizacja powinna mieć kompletny rejestr systemów AI, przeprowadzoną klasyfikację ryzyka, podstawową dokumentację dla systemów wysokiego ryzyka oraz wdrożone procedury zarządzania. To solidna podstawa, ale nie koniec pracy. AI Act to regulacja dynamiczna – Komisja Europejska regularnie aktualizuje wytyczne, a krajowe organy nadzorcze doprecyzowują interpretacje. Zgodność z AI Act to proces ciągły, nie jednorazowy projekt.

Warto też pamiętać, że AI Act nie działa w izolacji – nakłada się na RODO, dyrektywę NIS2 i sektorowe regulacje (np. w finansach czy ochronie zdrowia). Zarządzanie zgodnością w tych obszarach warto traktować jako zintegrowany system, a nie osobne silosy.

Źródła

- Rozporządzenie (UE) 2024/1689 – AI Act – EUR-Lex

- EU AI Act – European Commission Digital Strategy

- ENISA – Artificial Intelligence Cybersecurity

- AI Act Explorer – Interaktywna nawigacja po przepisach

- UODO – Sztuczna inteligencja a ochrona danych osobowych