- Trzy progi kar w AI Act

- Za co grozi najwyższa kara (35 mln EUR / 7%)

- Niższe progi: 15 mln EUR / 3% i 7,5 mln EUR / 1,5%

- Czym jest „globalny obrót” w AI Act

- Kary dla dostawców GPAI (modele ogólnego przeznaczenia)

- MŚP i startupy – niższe sufity kar dzięki art. 99 ust. 6

- Jak liczyć „globalny obrót” w praktyce (MŚP i startupy)

- GDPR vs AI Act – porównanie progów

- Polskie case studies RODO – czego się spodziewać przy AI Act

- Praktyczne wnioski dla organizacji budujących AI

EU AI Act wprowadza najbardziej dotkliwy system kar finansowych, z jakim do tej pory spotkały się projekty wykorzystujące sztuczną inteligencję w Europie – w górnym progu nawet wyższy niż w RODO (7% vs 4% globalnego obrotu). Jednocześnie rozporządzenie zawiera mechanizmy łagodzące dla MŚP i startupów, które zmieniają sposób liczenia maksymalnej kary.

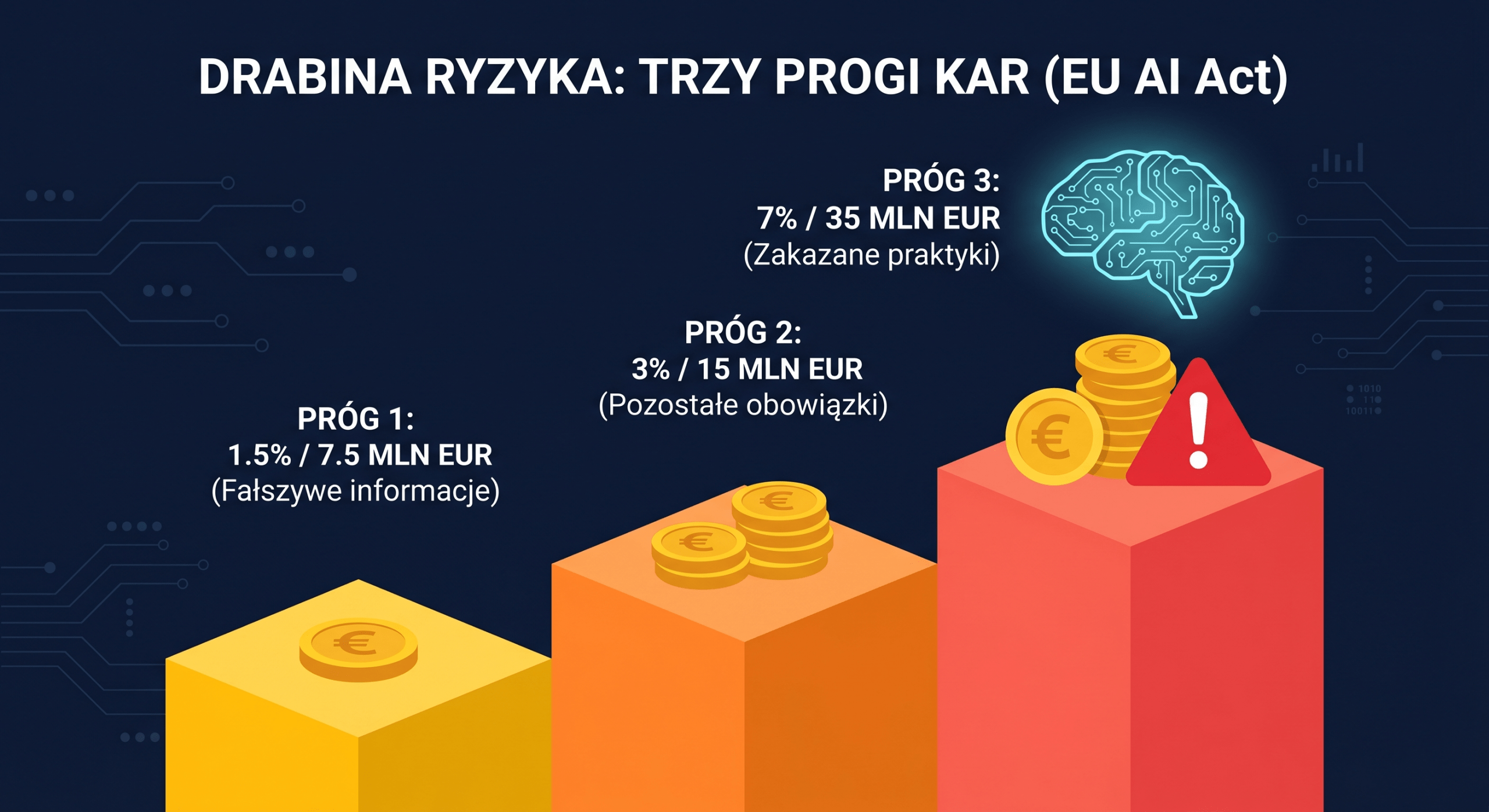

Trzy progi kar w AI Act

AI Act przewiduje trzy poziomy administracyjnych kar pieniężnych, powiązanych z rodzajem naruszenia.

| Naruszenie | Maksymalna kara |

|---|---|

| Zakazane praktyki AI (art. 5) oraz poważne naruszenia wymogów dotyczących danych | Do 35 mln EUR lub 7% globalnego obrotu z poprzedniego roku (dla dużych firm – wyższa wartość) |

| Naruszenia innych obowiązków (np. wymogów dla systemów wysokiego ryzyka, obowiązków dostawcy i użytkownika) | Do 15 mln EUR lub 3% globalnego obrotu (dla dużych firm – wyższa wartość) |

| Przekazanie organom lub jednostkom notyfikowanym nieprawidłowych, niepełnych lub wprowadzających w błąd informacji | Do 7,5 mln EUR lub 1,5% globalnego obrotu (dla dużych firm – wyższa wartość) |

Oficjalne FAQ Komisji Europejskiej potwierdza trzy progi: 35 mln EUR / 7%, 15 mln EUR / 3% oraz 7,5 mln EUR / 1,5% globalnego obrotu w poprzednim roku obrotowym. Komentatorzy podkreślają, że w praktyce organy – podobnie jak przy RODO – będą brały pod uwagę nie tylko surowe limity, ale też okoliczności naruszenia.

Za co grozi najwyższa kara (35 mln EUR / 7%)

Najwyższy próg dotyczy naruszeń zakazanych praktyk AI oraz określonych naruszeń związanych z danymi treningowymi.

- Zakazane praktyki (art. 5 AI Act), m.in. manipulacyjne techniki wpływające na zachowanie ludzi w sposób powodujący poważną szkodę, tzw. „social scoring” obywateli przez władze publiczne czy zdalna biometryczna identyfikacja w czasie rzeczywistym w przestrzeni publicznej (poza bardzo wąskimi wyjątkami).

- Poważne naruszenia wymogów dotyczących jakości i zarządzania danymi, jeśli są powiązane z zakazanymi systemami lub prowadzą do szczególnie wysokiego ryzyka dla praw podstawowych.

Dla dużych grup kapitałowych kara może sięgnąć 7% całkowitego światowego obrotu z poprzedniego roku obrotowego – to poziom wyższy niż maksymalny próg 4% w RODO.

Niższe progi: 15 mln EUR / 3% i 7,5 mln EUR / 1,5%

Drugi próg (15 mln EUR / 3%) obejmuje naruszenia pozostałych obowiązków AI Act, w szczególności związanych z systemami wysokiego ryzyka.

- Brak systematycznej oceny i zarządzania ryzykiem (risk management system) w systemie wysokiego ryzyka.

- Niewystarczająca dokumentacja techniczna, brak rejestrów logów lub brak przejrzystości wobec użytkowników.

- Nieprzestrzeganie wymogów nadzoru nad systemem przez człowieka (human oversight) czy jakości danych.

Trzeci próg (7,5 mln EUR / 1,5%) dotyczy sytuacji, w których operator dostarcza organom nadzoru lub jednostkom notyfikowanym informacje nieprawdziwe, niepełne albo wprowadzające w błąd – np. w procedurze oceny zgodności lub podczas inspekcji.

Czym jest „globalny obrót” w AI Act

AI Act odwołuje się do „całkowitego światowego obrotu za poprzedni rok obrotowy” („total worldwide annual turnover for the preceding financial year”), analogicznie do konstrukcji znanej z RODO.

- Podstawą jest obrót (przychody) całego przedsiębiorstwa jako „undertaking”, a nie tylko jednej spółki operacyjnej – w prawie UE pojęcie „undertaking” zwykle obejmuje całą grupę kapitałową jako jedną jednostkę gospodarczą.

- Chodzi o przychody z działalności na całym świecie, a nie tylko w UE – podobnie jak w RODO, maksimum kary liczy się od globalnych przychodów z poprzedniego roku.

- W praktyce przyjmuje się, że to przychody netto ze sprzedaży towarów i usług, po odjęciu rabatów handlowych i podatków obrotowych (np. VAT), tak jak opisuje to m.in. brytyjski ICO i inne wytyczne dot. „total worldwide annual turnover”.

Dla podmiotów z grup kapitałowych oznacza to, że bazą do wyliczenia maksymalnej kary może być skonsolidowany obrót całej grupy, a nie jedynie spółki‑córki, która formalnie wdrożyła dany system AI – taka interpretacja została już przesądzona w kontekście RODO przez Trybunał Sprawiedliwości UE.

Kary dla dostawców GPAI (modele ogólnego przeznaczenia)

AI Act wydziela osobną kategorię kar dla dostawców tzw. general-purpose AI models (GPAI) – dużych modeli ogólnego przeznaczenia, takich jak modele językowe czy generatywne systemy multimodalne. Wynika to z założenia, że błędy na poziomie modelu podstawowego mogą rozlać się na setki lub tysiące downstreamowych zastosowań u integratorów.

Artykuł 101 AI Act przyznaje Komisji Europejskiej (a nie krajowym organom) uprawnienie do nakładania na dostawców GPAI kar do 15 mln EUR lub 3% globalnego obrotu z poprzedniego roku obrotowego – zawsze przyjmując wyższą z tych wartości. Ten reżim jest niezależny od „głównej” drabinki z art. 99 (35 mln / 7%, 15 mln / 3%, 7,5 mln / 1,5%) i dotyczy wyłącznie naruszeń obowiązków specyficznych dla GPAI (rozdział V).

| Naruszenie – dostawca GPAI | Maksymalna kara (Art. 101) |

|---|---|

| Naruszenie obowiązków AI Act dotyczących GPAI (np. brak wymaganej dokumentacji, brak „model card”, niewypełnienie obowiązków dot. praw autorskich) | Do 15 mln EUR lub 3% globalnego obrotu (wyższa wartość) |

| Brak współpracy z Komisją (brak dokumentów, informacji, zignorowanie środków zaradczych z art. 93) | Do 15 mln EUR lub 3% globalnego obrotu (wyższa wartość) |

| Odmowa udzielenia dostępu do modelu GPAI / GPAI o ryzyku systemowym na potrzeby ewaluacji (art. 92) | Do 15 mln EUR lub 3% globalnego obrotu (wyższa wartość) |

Komisja – zgodnie z brzmieniem art. 101 – ma brać pod uwagę naturę, wagę i czas trwania naruszenia oraz zasadę proporcjonalności; dodatkowo ma uwzględniać dobrowolne zobowiązania wynikające z kodeksów postępowania (Code of Practice for GPAI). W praktyce oznacza to, że aktywne uczestnictwo dostawcy w unijnym Code of Practice GPAI oraz realne wykonywanie tych zobowiązań może obniżyć ryzyko maksymalnej kary – choć nie wyłączy jej całkowicie.

Obowiązki GPAI obejmują m.in. szczegółową dokumentację techniczną modelu, ujawnienie kluczowych informacji o danych treningowych, metrykach, ograniczeniach i znanych ryzykach (również poprzez standaryzowane „model cards” zgodne z załącznikami AI Act), a także przekazywanie integratorom jasnych wytycznych co do bezpiecznego i zgodnego z prawem użycia modelu. Brak takiej dokumentacji, odmowa współpracy z AI Office lub utrudnianie ewaluacji modelu przez Komisję to właśnie typowe sytuacje, w których może zostać uruchomiony art. 101.

Co ważne, dostawca GPAI może być potencjalnie dotknięty dwoma poziomami odpowiedzialności: z jednej strony ogólnymi karami z art. 99 (np. jeśli jego własny system jest użyty w zakazany sposób lub jako system wysokiego ryzyka), z drugiej – specjalnym reżimem art. 101 za naruszenia obowiązków specyficznych dla GPAI. Dla dużych podmiotów (tzw. foundation model providers) oznacza to konieczność traktowania compliance z AI Act jako krytycznego elementu zarządzania ryzykiem regulacyjnym, na równi z RODO czy regulacjami sektorowymi.

MŚP i startupy – niższe sufity kar dzięki art. 99 ust. 6

AI Act zawiera specjalną regułę dla MŚP (w tym startupów), która praktycznie zmienia sposób liczenia maksymalnej kary.

- Co do zasady, dla dużych firm stosuje się wyższą z wartości: kwotę stałą (np. 35 mln EUR) lub procent globalnego obrotu (np. 7%).

- Dla MŚP – wprost odwrotnie: stosuje się niższą z tych dwóch wartości.

Przykład: startup z obrotem 1 mln EUR, który wdrożył zakazaną praktykę (np. system do rozpoznawania emocji do monitorowania pracowników, zakazany przez art. 5).

- 7% z 1 mln EUR = 70 000 EUR.

- Kwota stała w tym progu to 35 mln EUR.

- Dla MŚP maksymalna kara to niższa z tych wartości, czyli 70 000 EUR, a nie 35 mln EUR.

Inny przykład: mały sklep internetowy z obrotem 200 000 EUR, który podaje organowi błędne informacje (trzeci próg – 7,5 mln EUR / 1,5%). 1,5% z 200 000 EUR to 3 000 EUR, więc maksymalna kara dla MŚP wyniesie 3 000 EUR, a nie 7,5 mln EUR. Dla dużej korporacji w tej samej sytuacji bazą byłaby natomiast wyższa z wartości: 7,5 mln EUR lub 1,5% globalnego obrotu.

Reguła MŚP nie usuwa ryzyka – tylko obniża sufit. Dla młodego startupu kara rzędu kilkudziesięciu tysięcy euro nadal może być egzystencjalna.

Jak liczyć „globalny obrót” w praktyce (MŚP i startupy)

Praktyczne liczenie globalnego obrotu dla potrzeb AI Act można oprzeć na podejściu wypracowanym przy RODO oraz na standardowych definicjach MŚP w prawie UE.

Krok 1 – Sprawdź, czy faktycznie jesteś MŚP

- AI Act odsyła do definicji MŚP z rekomendacji Komisji 2003/361/WE: liczba pracowników oraz próg obrotu / sumy bilansowej.

- Mikroprzedsiębiorstwo: <10 pracowników i obrót / suma bilansowa ≤ 2 mln EUR; małe: <50 pracowników i obrót ≤ 10 mln EUR; średnie: <250 pracowników i obrót ≤ 50 mln EUR lub suma bilansowa ≤ 43 mln EUR.

- Jeśli masz inwestora korporacyjnego lub jesteś w grupie, musisz doliczyć partnerów i przedsiębiorstwa powiązane – liczy się agregat, nie wyłącznie spółka‑córka.

Krok 2 – Określ „poprzedni rok obrotowy”

- Analogicznie jak w RODO: liczy się ostatni zamknięty rok finansowy poprzedzający naruszenie, na podstawie zatwierdzonych sprawozdań.

- Jeśli firma ma przesunięty rok obrotowy, organy biorą pod uwagę ten konkretny rok, a nie rok kalendarzowy.

Krok 3 – Wyznacz globalny obrót

- Zsumuj przychody ze sprzedaży towarów i usług we wszystkich krajach, w których operuje grupa – bez ograniczania się do UE.

- Przyjmij wartości bez VAT i podobnych podatków, po uwzględnieniu rabatów handlowych; tak rozumie „turnover” m.in. brytyjski ICO oraz inne wytyczne w podobnych reżimach.

- Dla grup kapitałowych wyjściem jest zwykle skonsolidowane sprawozdanie finansowe; analogicznie do podejścia przy RODO.

Krok 4 – Zastosuj odpowiedni próg i regułę MŚP

- Wylicz procentową wartość kary (7%, 3% lub 1,5% globalnego obrotu).

- Porównaj ją z kwotą stałą (35 mln, 15 mln lub 7,5 mln EUR).

- Dla MŚP przyjmuje się niższą z tych wartości; dla pozostałych – wyższą.

W skrajnych przypadkach (startup przed przychodami, obrót bliski zeru) część komentatorów zakłada, że procentową bazą będzie de facto „0”, a nacisk organów przesunie się raczej na środki niefinansowe: zakaz stosowania systemu, nakaz dostosowania czy wstrzymanie wdrażania. Jest to jednak obszar, w którym praktyka orzecznicza będzie dopiero powstawać.

GDPR vs AI Act – porównanie progów

Struktura kar AI Act przypomina RODO, ale skala jest inna.

- RODO: do 10 mln EUR lub 2% globalnego obrotu (niższy próg) oraz do 20 mln EUR lub 4% globalnego obrotu (wyższy próg), zależnie od rodzaju naruszenia; zawsze stosuje się wyższą z wartości.

- AI Act: do 35 mln EUR / 7%, 15 mln EUR / 3% oraz 7,5 mln EUR / 1,5% – przy czym dla MŚP stosuje się niższą z wartości, a dla pozostałych – wyższą.

| Reżim | Niższy próg | Wyższy próg | Baza obliczeń |

|---|---|---|---|

| RODO (GDPR) | Do 10 mln EUR lub 2% globalnego obrotu (zawsze wyższa wartość) | Do 20 mln EUR lub 4% globalnego obrotu (zawsze wyższa wartość) | Globalny obrót „undertaking” z poprzedniego roku obrotowego |

| AI Act – duże firmy | Do 7,5 mln EUR lub 1,5% (fałszywe informacje) | Do 35 mln EUR lub 7% (zakazane praktyki); 15 mln EUR / 3% pozostałe obowiązki | Globalny obrót „undertaking” z poprzedniego roku obrotowego |

| AI Act – MŚP | Te same kwoty i procenty, ale stosuje się niższą z wartości (kwotowej i procentowej) | Globalny obrót MŚP liczony jak wyżej | |

Polskie case studies RODO – czego się spodziewać przy AI Act

Choć AI Act dopiero zaczyna być egzekwowany, dobrym punktem odniesienia są decyzje Prezesa UODO w sprawach RODO – pokazują, jak polski organ podchodzi do proporcjonalności kar.

- Broker danych – ok. 1 mln PLN – pierwsza wysoka kara UODO za brak realizacji obowiązku informacyjnego z art. 14 RODO wobec ponad 6,6 mln jednoosobowych przedsiębiorców. Firma uznała, że wysłanie listów poleconych będzie zbyt kosztowne, ograniczając się do publikacji informacji na stronie – organ uznał to za niewystarczające.

- Morele.net – 2,8 mln PLN, potem 3,8 mln PLN – za niewystarczające środki techniczne i organizacyjne, które doprowadziły do wycieku danych ok. 2,2 mln klientów; po uchyleniu pierwszej decyzji przez sąd administracyjny UODO ponownie nałożył karę, tym razem ponad 3,8 mln PLN.

- Fortum Marketing and Sales Polska – 4,9 mln PLN – rekordowa kara za brak odpowiednich środków bezpieczeństwa oraz brak należytej weryfikacji procesora, który przetwarzał dane w imieniu spółki. Procesor otrzymał dodatkowo karę 250 000 PLN.

- Virgin Mobile Polska – 1,6 mln PLN – za niewdrożenie odpowiednich środków technicznych i organizacyjnych zapewniających bezpieczeństwo przetwarzania danych.

W decyzjach UODO powtarza się kilka kryteriów, które są też wprost wymienione w AI Act: liczba osób, których dotyczy naruszenie, kategorie danych, czas trwania, stopień winy, współpraca z organem oraz wcześniejsze naruszenia. Można się spodziewać, że organy AI Act w Polsce będą stosowały bardzo podobną logikę przy wymiarze kar za naruszenia związane z systemami AI.

Praktyczne wnioski dla organizacji budujących AI

Dla firm rozwijających AI – od startupów po duże grupy – najważniejsze jest takie zaprojektowanie procesu wytwarzania i wdrażania systemów, aby w ogóle nie zbliżać się do górnych progów kar.

- Mapa zastosowań AI i klasyfikacja ryzyka – zidentyfikuj wszystkie systemy AI, które budujesz lub kupujesz, i przypisz je do kategorii AI Act (minimalne ryzyko, systemy ograniczonego ryzyka, wysokiego ryzyka, zakazane).

- Świadome omijanie zakazanych praktyk – w procesie produktowym wprost zakazuj pewnych klas funkcjonalności (np. scoringu obywateli, rozpoznawania emocji pracowników), aby nie ryzykować wejścia w art. 5 AI Act.

- Wzmocnienie „compliance‑by‑design” – dokumentacja danych, governance, logowanie, testy bezpieczeństwa i nadzór człowieka powinny być częścią definicji „done” w projektach AI, nie dodatkiem na końcu.

- Integracja z RODO i bezpieczeństwem – większość wymogów AI Act (risk management, data governance, nadzór) dobrze spina się z już istniejącymi procesami RODO, ISO 27001 czy NIS2 – warto budować jeden zintegrowany system, zamiast osobnych „silosów zgodności”.

- Świadome planowanie ryzyka finansowego – MŚP powinny policzyć hipotetyczne maksymalne kary na bazie własnego obrotu (przy każdym z trzech progów), aby realnie ocenić wagę zgodności (i przygotować się np. na pytania inwestorów).

- Wykorzystanie narzędzi wsparcia dla MŚP – AI Act przewiduje m.in. priorytetowy dostęp MŚP do piaskownic regulacyjnych i obniżone opłaty za ocenę zgodności; w praktyce może to być jedyny bezpieczny sposób przetestowania niektórych zastosowań wysokiego ryzyka.

Z perspektywy inżyniera i założyciela startupu kluczowe jest nie tyle znanie każdego przepisu AI Act, ile wbudowanie wymogów regulacyjnych w architekturę produktów i procesy developmentu – podobnie jak stało się to wcześniej z RODO.

Źródła

- Navigating the AI Act – European Commission FAQ

- Article 99: Penalties – EU Artificial Intelligence Act

- EU AI Act Fines & Penalties 2026 Guide | AIActStack

- EU AI Act for SMEs & Startups – ReguMatrix

- Fines / Penalties – General Data Protection Regulation (GDPR)

- The President of the Personal Data Protection Office again fined Morele.net company – UODO

- Record fine imposed on controller for personal data breach – Fortum case – UODO

- A million PLN fine for GDPR – data broker case

- Poland: UODO fines Virgin Mobile PLN 1.6M for GDPR violations

- GDPR fines to be determined by reference to global turnover of corporate group