Rosnące zapotrzebowanie na moc obliczeniową centrów danych staje się jednym z kluczowych problemów infrastrukturalnych branży technologicznej. Według szacunków Lawrence Berkeley National Laboratory, do 2028 roku centra danych mogą odpowiadać za nawet 12% całkowitego zużycia energii elektrycznej w Stanach Zjednoczonych. W odpowiedzi na to wyzwanie badacze z MIT i MIT-IBM Watson AI Lab opracowali nowe podejście do szybkiego szacowania poboru mocy przez obciążenia AI – metodę o nazwie EnergAIzer.

Problem z tradycyjnymi metodami estymacji

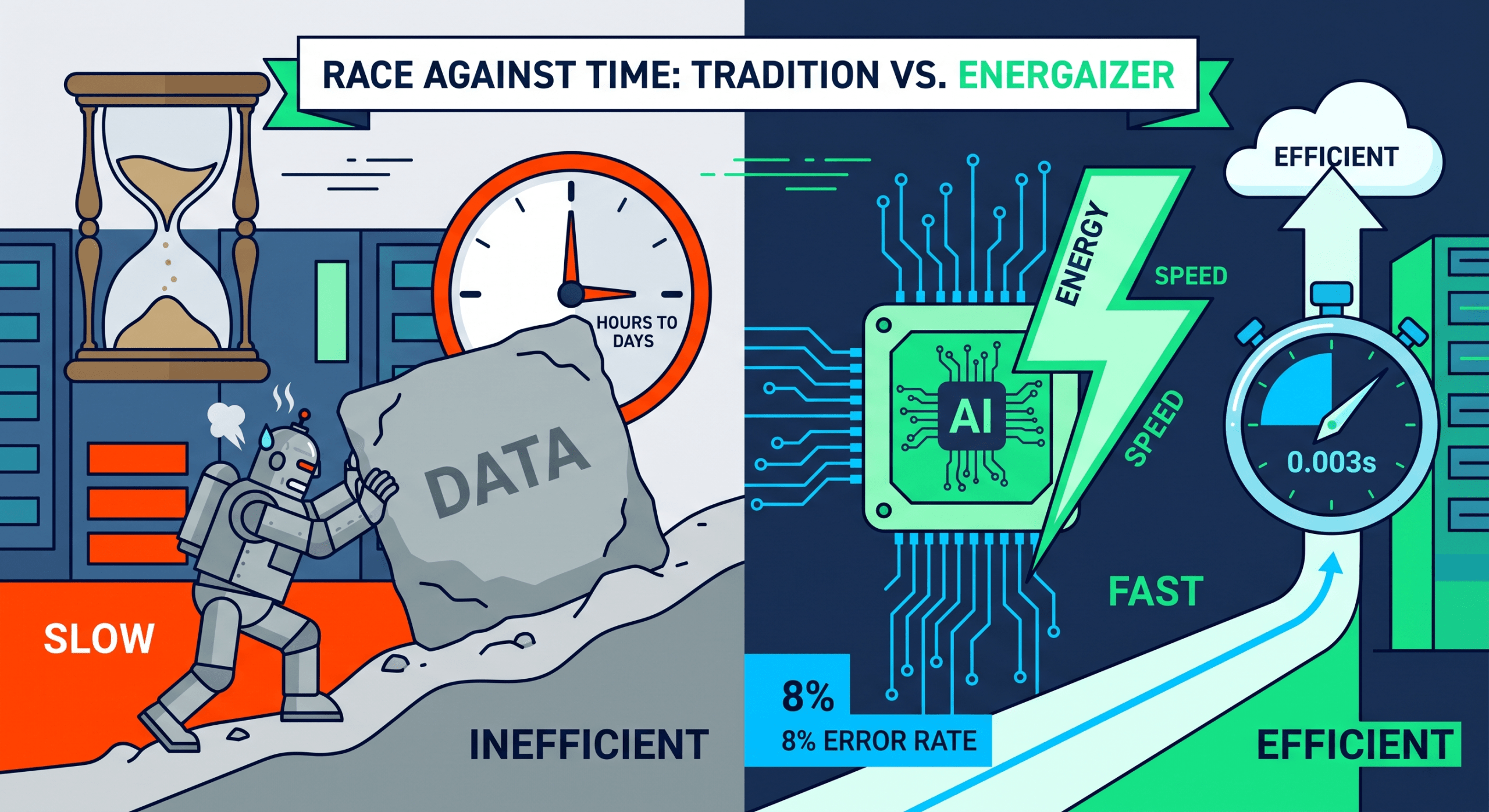

Tradycyjne techniki prognozowania zużycia energii przez GPU polegają na emulacji poszczególnych kroków obciążenia obliczeniowego – krok po kroku, moduł po module. Dla typowych zadań AI, takich jak trenowanie modeli czy preprocessing danych, taka symulacja może trwać od kilku godzin do kilku dni. Przy porównywaniu wielu konfiguracji sprzętowych lub algorytmów, operatorzy centrów danych stają przed wyborem między dokładnością a praktycznością – jedno lub drugie musiało ustępować. EnergAIzer rozwiązuje ten kompromis inaczej: zamiast emulować każdy krok, identyfikuje powtarzalne wzorce w obciążeniach AI i używa ich jako podstawy do szybkiej estymacji.

Jak działa EnergAIzer

Kluczową obserwacją zespołu było to, że deweloperzy algorytmów piszą programy w sposób zoptymalizowany pod kątem GPU – stosując regularne struktury dostępu do pamięci i równomierne rozłożenie pracy na równoległe rdzenie obliczeniowe. Ta regularność tworzy charakterystyczne wzorce poboru mocy, które można modelować bez potrzeby pełnej symulacji.

Model uwzględnia jednak nie tylko te powtarzalne struktury. W praktyce GPU ponosi też stałe koszty energetyczne związane z inicjalizacją programu oraz zmienne koszty wynikające z fluktuacji sprzętowych i konfliktów dostępu do pamięci. Aby to skompensować, badacze zebrali rzeczywiste pomiary z działających GPU i wygenerowali współczynniki korekcyjne, które poprawiają dokładność wyników.

Użytkownik podaje jako dane wejściowe:

- nazwę modelu AI, który chce uruchomić,

- liczbę i długość przetwarzanych próbek danych,

- konfigurację GPU (opcjonalnie – można ją modyfikować i obserwować wpływ na zużycie energii).

W odpowiedzi EnergAIzer zwraca szacowane zużycie energii – w ciągu kilku sekund.

Wyniki testów i dokładność

Podczas testów na rzeczywistych obciążeniach AI i rzeczywistych kartach GPU narzędzie osiągnęło błąd estymacji na poziomie około 8%. To wynik porównywalny z tradycyjnymi metodami, które jednak wymagają wielokrotnie więcej czasu. Co istotne, EnergAIzer działa nie tylko dla już wdrożonych konfiguracji sprzętowych – może przewidywać zużycie energii dla przyszłych GPU i konfiguracji prototypowych, o ile zmiany sprzętowe nie są radykalne.

| Cecha | Tradycyjne metody emulacji | EnergAIzer |

|---|---|---|

| Czas estymacji | Godziny do dni | Kilka sekund |

| Dokładność (błąd) | ~8% | ~8% |

| Obsługa nowych konfiguracji GPU | Ograniczona | Tak (przy stopniowych zmianach sprzętowych) |

| Wymagany poziom szczegółowości danych | Wysoki | Niski (wzorce optymalizacyjne) |

| Możliwość testowania scenariuszy “co jeśli” | Niepraktyczna | Tak |

Praktyczne zastosowania

EnergAIzer jest narzędziem użytecznym na kilku poziomach jednocześnie:

- Operatorzy centrów danych mogą używać go do bieżącego planowania alokacji zasobów obliczeniowych w sposób minimalizujący zużycie energii przy zachowaniu wymaganej przepustowości.

- Deweloperzy algorytmów i modeli AI mogą ocenić energetyczny ślad swojego modelu jeszcze przed jego wdrożeniem produkcyjnym – co umożliwia iterowanie projektu pod kątem efektywności energetycznej na wczesnym etapie.

- Projektanci sprzętu mogą symulować, jak przyszłe architektury GPU będą zachowywać się pod względem poboru mocy przy różnych typach obciążeń AI – bez konieczności budowania fizycznych prototypów.

Badanie zostało zaprezentowane na konferencji IEEE International Symposium on Performance Analysis of Systems and Software. Jego autorami są Kyungmi Lee (postdoc MIT, główny autor), Zhiye Song (doktorant EECS), Eun Kyung Lee i Xin Zhang z IBM Research, Tamar Eilam (IBM Fellow, główny naukowiec ds. zrównoważonego obliczania w IBM Research) oraz Anantha P. Chandrakasan – prowost MIT i profesor inżynierii elektrycznej i informatyki.

Co dalej z EnergAIzer

Obecna wersja narzędzia działa na poziomie pojedynczego GPU. Zespół badawczy planuje rozszerzyć EnergAIzer o obsługę rozproszonych środowisk obliczeniowych, w których wiele GPU współpracuje przy jednym obciążeniu – co jest typowe dla trenowania dużych modeli językowych. Praca nad skalowalnością narzędzia jest kluczowa, bo dopiero w środowiskach wieloGPU zużycie energii osiąga poziomy naprawdę znaczące dla bilansu energetycznego centrów danych.

„Aby naprawdę wpłynąć na zrównoważony rozwój, potrzebujemy narzędzia, które zapewni szybką ocenę energetyczną dla projektantów sprzętu, operatorów centrów danych i deweloperów algorytmów, tak aby wszyscy byli bardziej świadomi zużycia energii. Tym narzędziem zrobiliśmy jeden krok w tym kierunku.” – Kyungmi Lee, MIT

Projekt był częściowo finansowany przez MIT-IBM Watson AI Lab. To przykład współpracy akademicko-przemysłowej, która adresuje konkretny, mierzalny problem inżynieryjny – bez nadmiernych ambicji, ale z realnym potencjałem wpływu na praktykę operacyjną sektora AI.

Źródła

- A faster way to estimate AI power consumption – MIT News

- A faster way to estimate AI power consumption – MIT Climate Portal

- A faster way to estimate AI power consumption – EurekAlert!

- EnergAIzer’s Rapid Estimates Address Data Center Energy Challenges – Welcome AI